A complexidade da apresentação de dados para aprendizado profundo está aumentando a cada dia. As redes neurais de gráfico ( GNNs ) tornaram-se um dos avanços dos últimos anos. Mas por que exatamente os gráficos estão ganhando cada vez mais popularidade no aprendizado de máquina?

O objetivo final da minha narrativa é uma apresentação geral de gráficos em técnicas de aprendizado de máquina. O artigo não pretende ser um trabalho científico que descreva completamente todo o poder dos gráficos, mas apenas apresenta ao leitor esse mundo incrível e complexo. A publicação é perfeita, tanto para profissionais dedicados à batalha que ainda não estão familiarizados com a apresentação de gráficos em aprendizado profundo, quanto para iniciantes neste campo.

Introdução

O destaque automático dos recursos importantes necessários para resolver um problema é uma das principais razões para o uso bem-sucedido do aprendizado de máquina. Porém, tradicionalmente, ao trabalhar com gráficos, as abordagens de aprendizado de máquina contam com heurísticas definidas pelo usuário para extrair os recursos de codificação das informações gráficas estruturais. No entanto, a tendência dos últimos anos mudou: estão surgindo cada vez mais abordagens nas quais eles aprendem automaticamente a codificar a estrutura gráfica em investimentos de baixa dimensão usando métodos de aprendizado profundo e redução não linear de dimensões.

No aprendizado de máquina em gráficos, dois problemas centrais podem ser distinguidos: a inclusão de informações sobre a estrutura do gráfico no modelo (ou seja, uma maneira simples de codificar essas informações no vetor de característica) e a redução na dimensão do vetor de característica.

( ), . , , .

?

, , : ?

— . , , ( ) [1], [2], ( [3], [4] [5]), [6] [7].

CV/ML , , . , , [8].

, . . , , , .

, (embeddings), . , , , , (), . , , . , .

, . , , . , , , .

, (direct encoding), . . , , -. , , , .

DeepWalk node2vec . , . , .

( ). (DNGR SDNE), , [9].

, , , — ( ) , .

(.1). :

, , , ( , ). .

, . , ( , ). , , , , .

, , . , , . (, )

- , , / . ; ( ) , ( ). , .

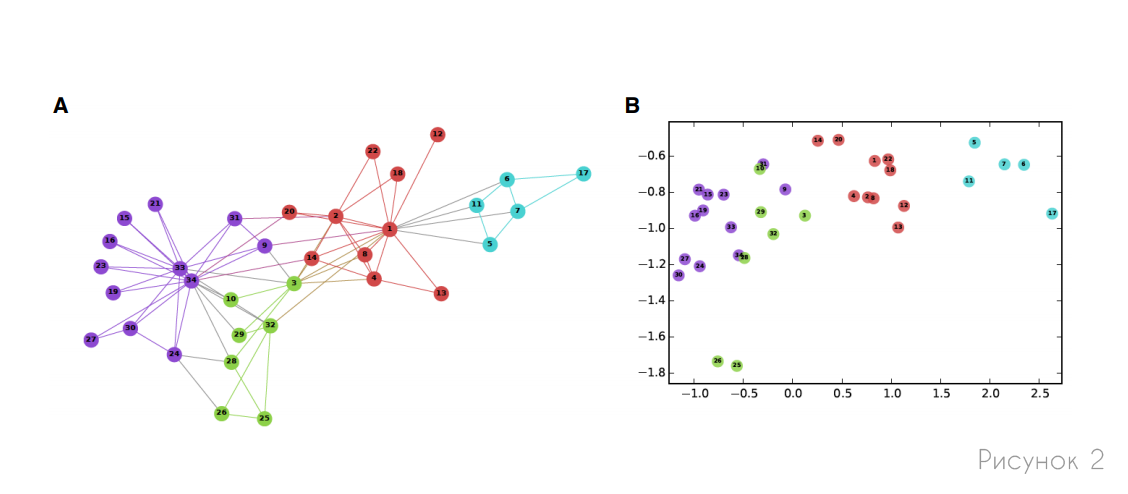

, , , . , (, ) . 2 , , .

, — , , ( ):

— , :

. , , . , , . , :

— , . , , 1, 0. . ( 1) :

— , (.. ) .

, -, , . , , , , , .

seq2seq , , . , seq2seq, GNN [10].

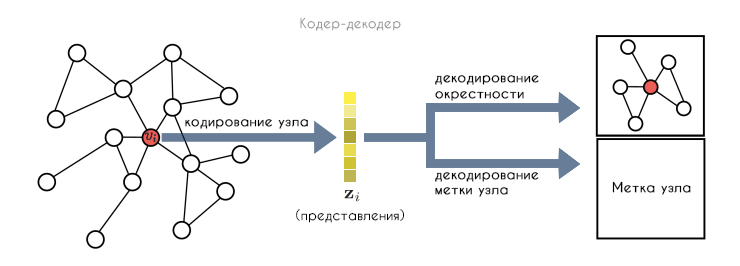

, :

- : , .

- ENC, . , .

- DEC, .

- , , .

. , . , .

, , . , , (.3). , , , .

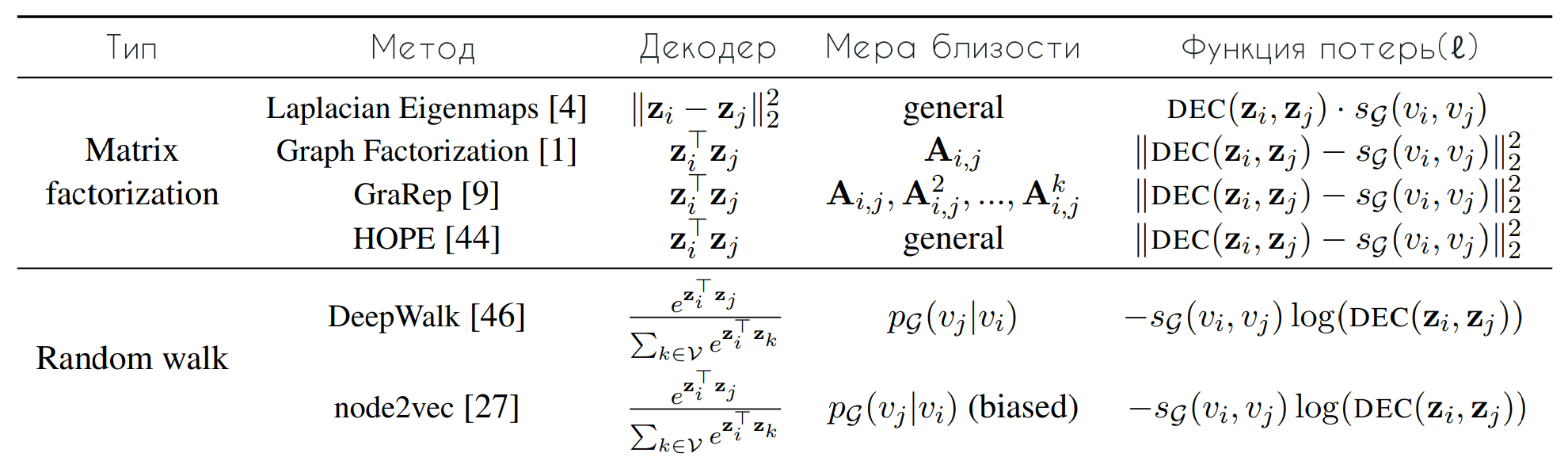

DeepWalk node2vec, , , . , , . , , :

— , , . , . , :

, (.. . — ( (2) ). , DeepWalk node2vec (3). DeepWalk softmax , . , node2vec (3), : , , " ".

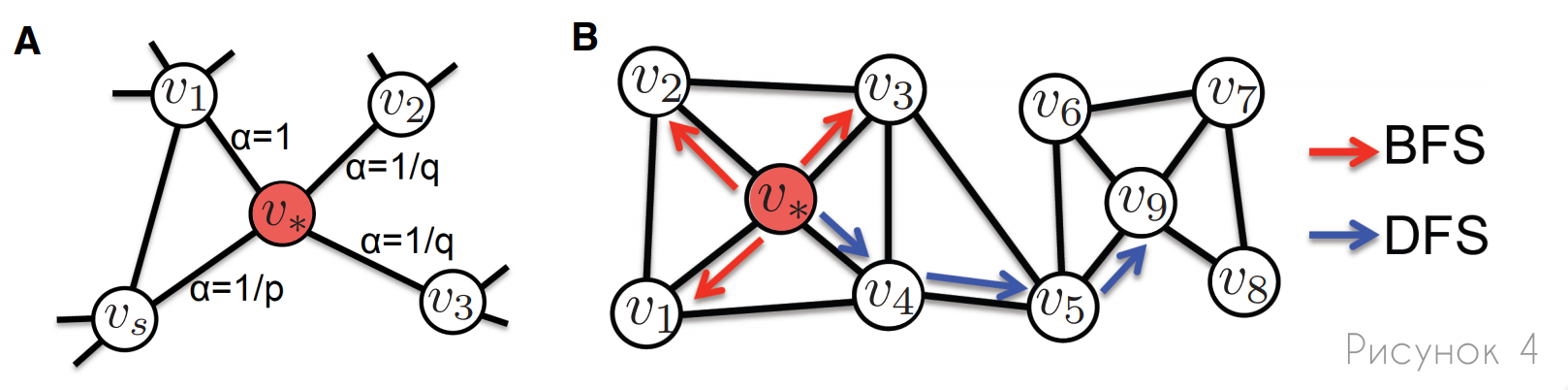

, node2vec DeepWalk , , . , node2vec : , (.4). , . , node2vec , .

A: , node2vec , p q. , , (α) , .

B: , (BFS) (DFS). , BFS, , , . , , DFS, .

, . , :

- (.. ). , , .

- . (, ), .

- . , , ( , ). , , , , .

/ . -, , , .

(DNGR) (SDNE) , : , . , — , (.5). DNGR SDNE , .

, ( — ). . DNGR SDNE , , :

, :

, , ( ), , . SDNE, DNGR, : , (.5).

SDNE DNGR , , , . DNGR , , DeepWalk node2vec. SDNE , .

, SDNE DNGR , ( ), - . , .

, . . , , , [9], . , .

. , , , , , , .

, , , .

. (. ), ( ). . , , , , , , — , , , . , , , .

. , , - , , . , , , , .

. , , , . , , , . , .

. , , . , , . , , , . , , , , .

, — . , , .

[1] — W. L. Hamilton, Z. Ying, and J. Leskovec, "Inductive representation learning on large graphs," NIPS 2017, pp. 1024–1034, 2017.

[2] — T. N. Kipf and M. Welling, "Semi-supervised classification with graph convolutional networks," ICLR 2017, 2017.

[3] — A. Sanchez-Gonzalez, N. Heess, J. T. Springenberg, J. Merel, M. Riedmiller, R. Hadsell, and P. Battaglia, "Graph networks as learnable physics engines for inference and control," arXiv

preprint arXiv:1806.01242, 2018.

[4] — P. Battaglia, R. Pascanu, M. Lai, D. J. Rezende et al., "Interaction networks for learning about objects, relations and physics," in NIPS 2016, 2016, pp. 4502–4510.

[5] — A. Fout, J. Byrd, B. Shariat, and A. Ben-Hur, "Protein interface prediction using graph convolutional networks," in NIPS 2017, 2017, pp. 6530–6539.

[6] — T. Hamaguchi, H. Oiwa, M. Shimbo, and Y. Matsumoto, "Knowledge transfer for out-of-knowledge-base entities: A graph neural network approach," in IJCAI 2017, 2017, pp. 1802–1808.

[7] — H. Dai, E. B. Khalil, Y. Zhang, B. Dilkina, and L. Song, "Learning combinatorial optimization algorithms over graphs," arXiv preprint arXiv:1704.01665, 2017.

[8] — X. Liang, X. Shen, J. Feng, F. Lin, S. Yan, "Semantic Object Parsing with Graph LSTM", arXiv:1603.07063v1 [cs.CV] 23 Mar 2016.

[9] — Z. Wu, S. Pan, F. Chen, G. Long, C. Zhang, Philip S. Yu, "A Comprehensive Survey on Graph Neural Networks", arXiv:1901.00596v4 [cs.LG] 4 Dec 2019.

[10] - P. Veličković, G. Cucurull, A. Casanova, A. Romero, P. Liò, Y. Bengio, “Graph Attention Networks”, arXiv: 1710.10903v3 [stat.ML] 4 de fevereiro de 2018.

Referências

Redes neurais de grafos: uma revisão dos métodos e da representação de aplicativos

Aprendendo sobre gráficos: métodos e aplicativos