प्राकृतिक भाषा प्रसंस्करण के लिए मशीन लर्निंग में प्रगति पिछले कुछ वर्षों में काफी तेजी से बढ़ी है। मॉडल ने अनुसंधान प्रयोगशालाओं को छोड़ दिया और प्रमुख डिजिटल उत्पादों की नींव बन गए। इसका एक अच्छा उदाहरण हालिया घोषणा है कि Google की खोज के पीछे BERT मॉडल मुख्य घटक बन गया है । Google का मानना है कि यह कदम (जो कि खोज इंजन में प्राकृतिक भाषा को समझने के एक उन्नत मॉडल की शुरूआत है) "पिछले पांच वर्षों में सबसे बड़ी सफलता और खोज इंजन के इतिहास में सबसे महत्वपूर्ण में से एक का प्रतिनिधित्व करता है।"

– BERT' . , , , , .

, Colab.

: SST2

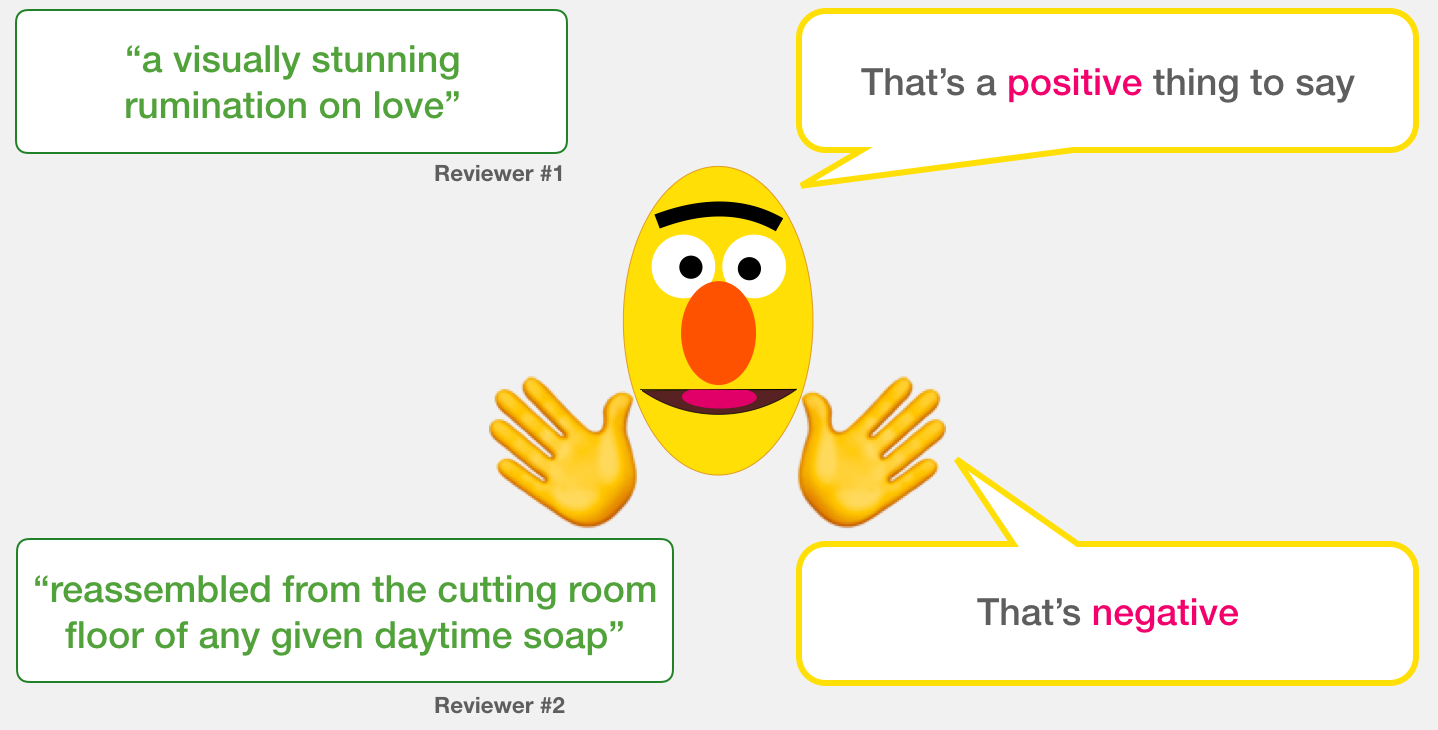

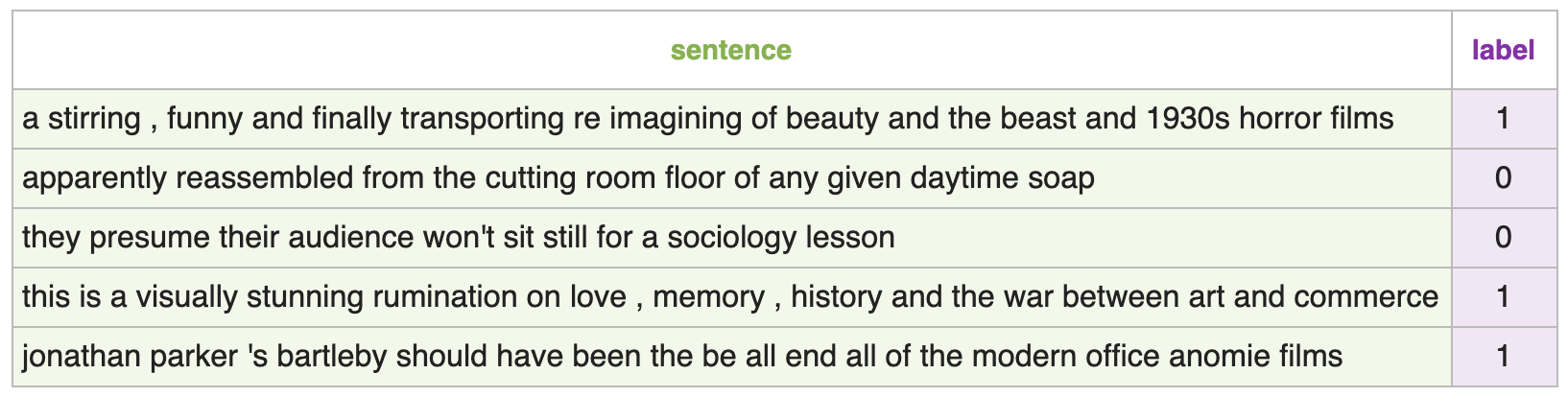

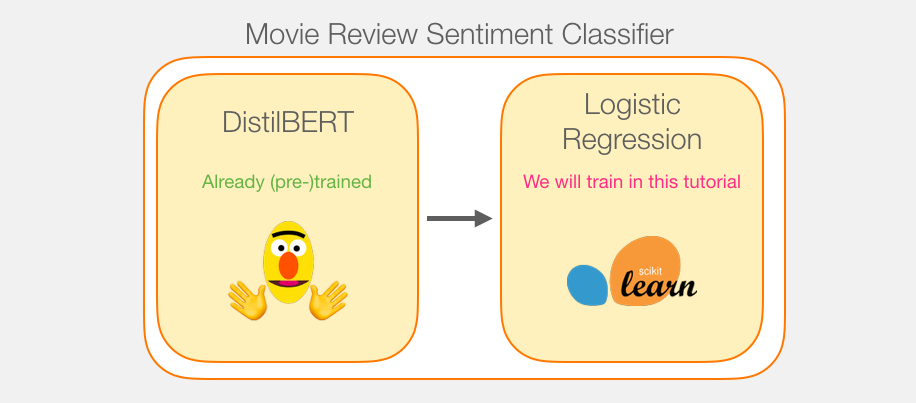

SST2, , ( 1), ( 0):

:

– , ( , ) 1 ( ), 0 ( ). :

:

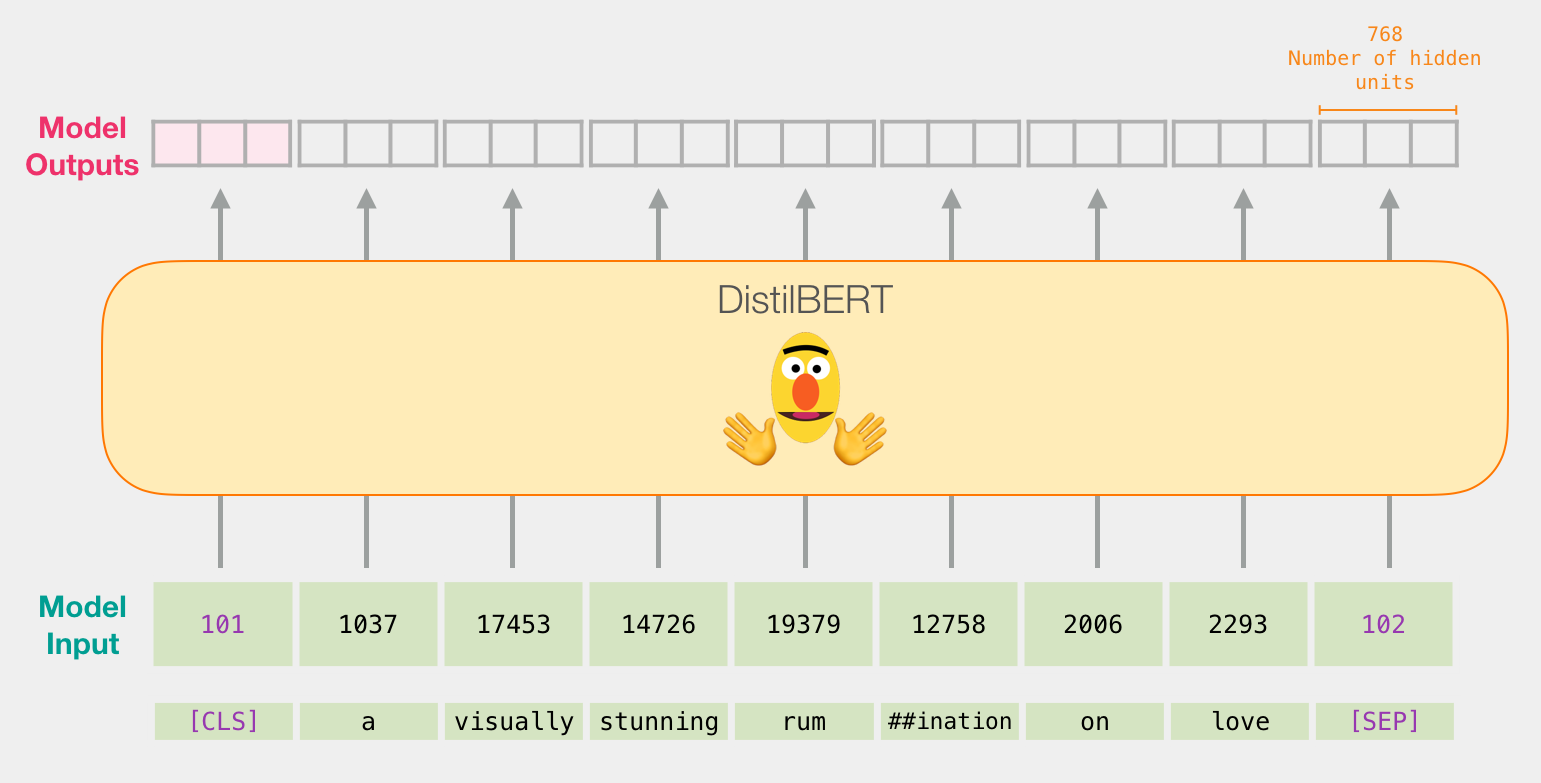

, , 768. , .

, BERT, ELMO ( NLP ): ( [CLS]).

, , . DistilBERT', . , , «» BERT', . , , BERT , [CLS] . , , . , , BERT .

transformers DistilBERT', .

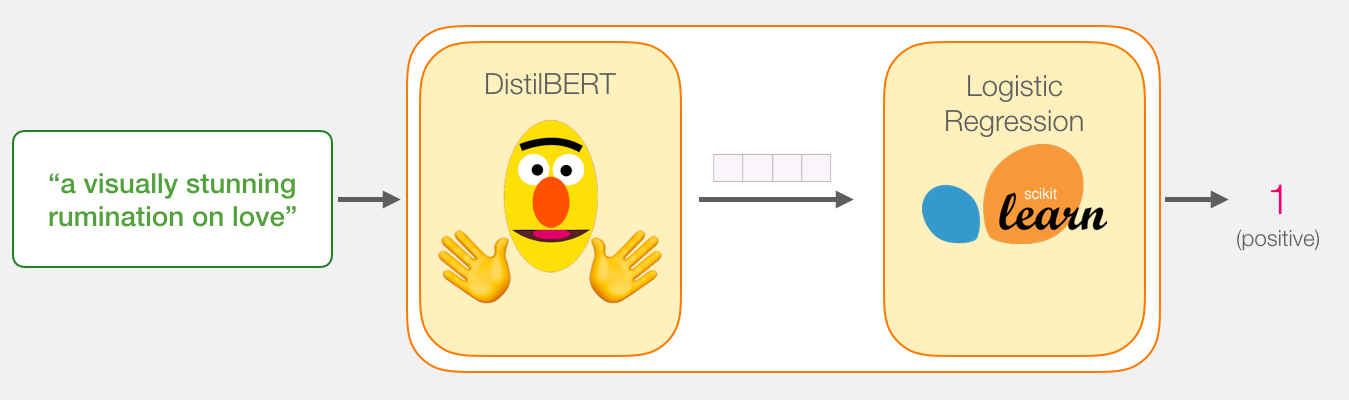

, . DistilBERT' 2 .

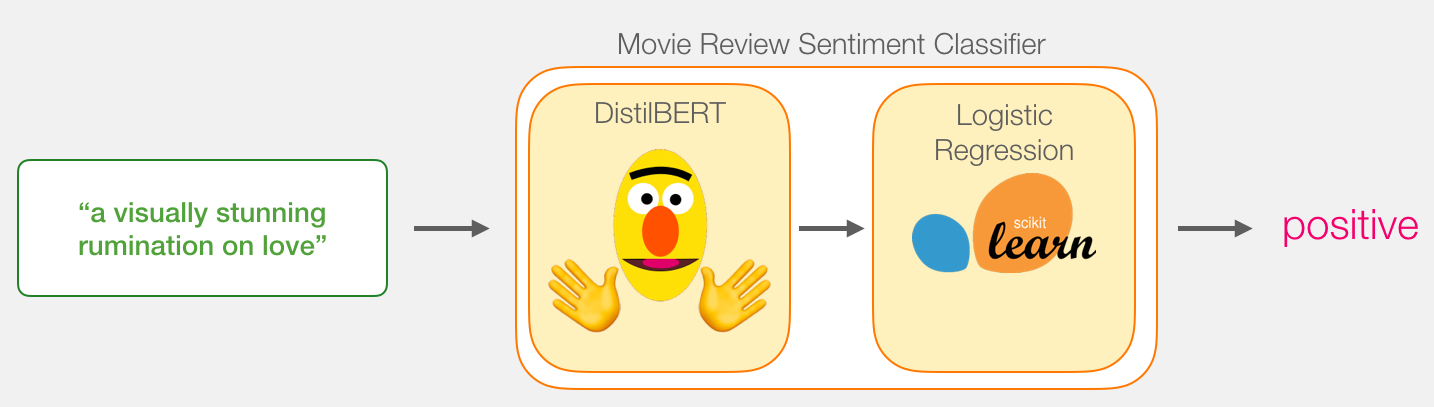

DistilBERT'. Scikit Learn. , , :

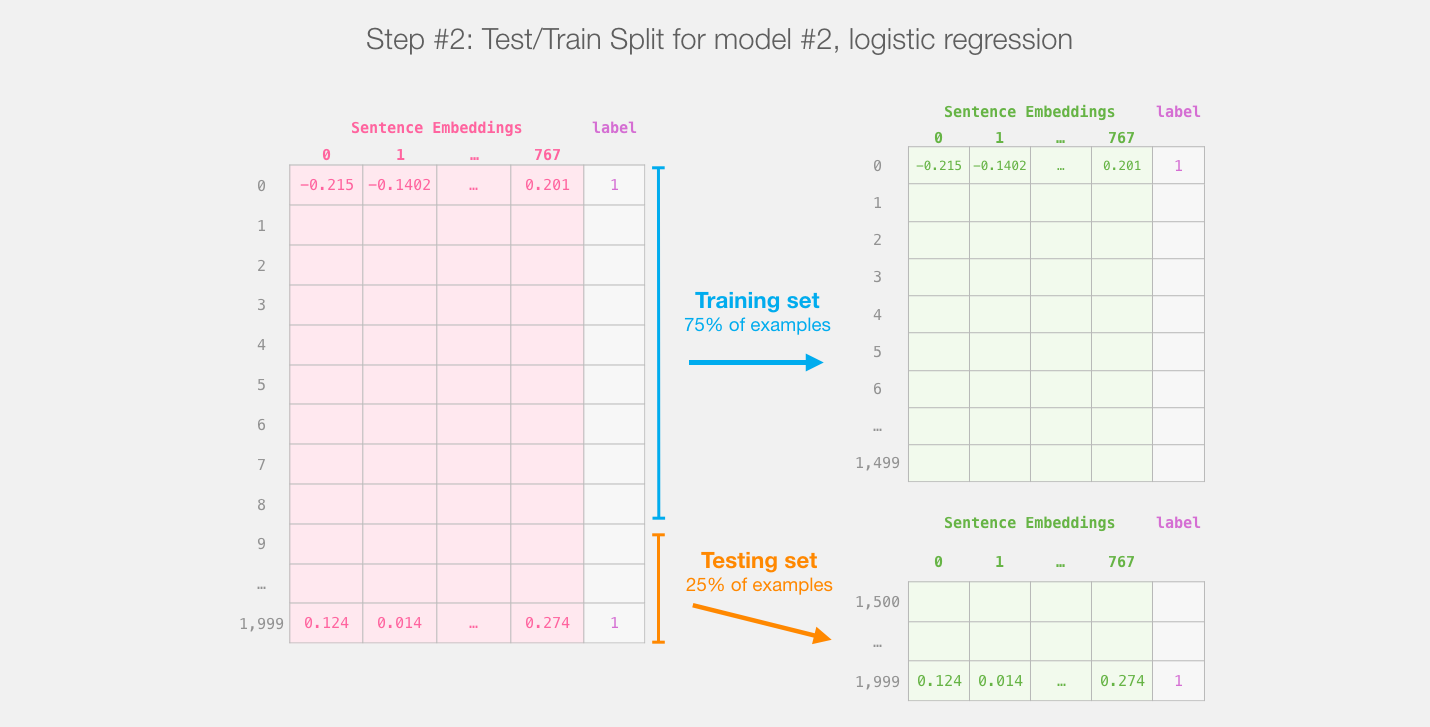

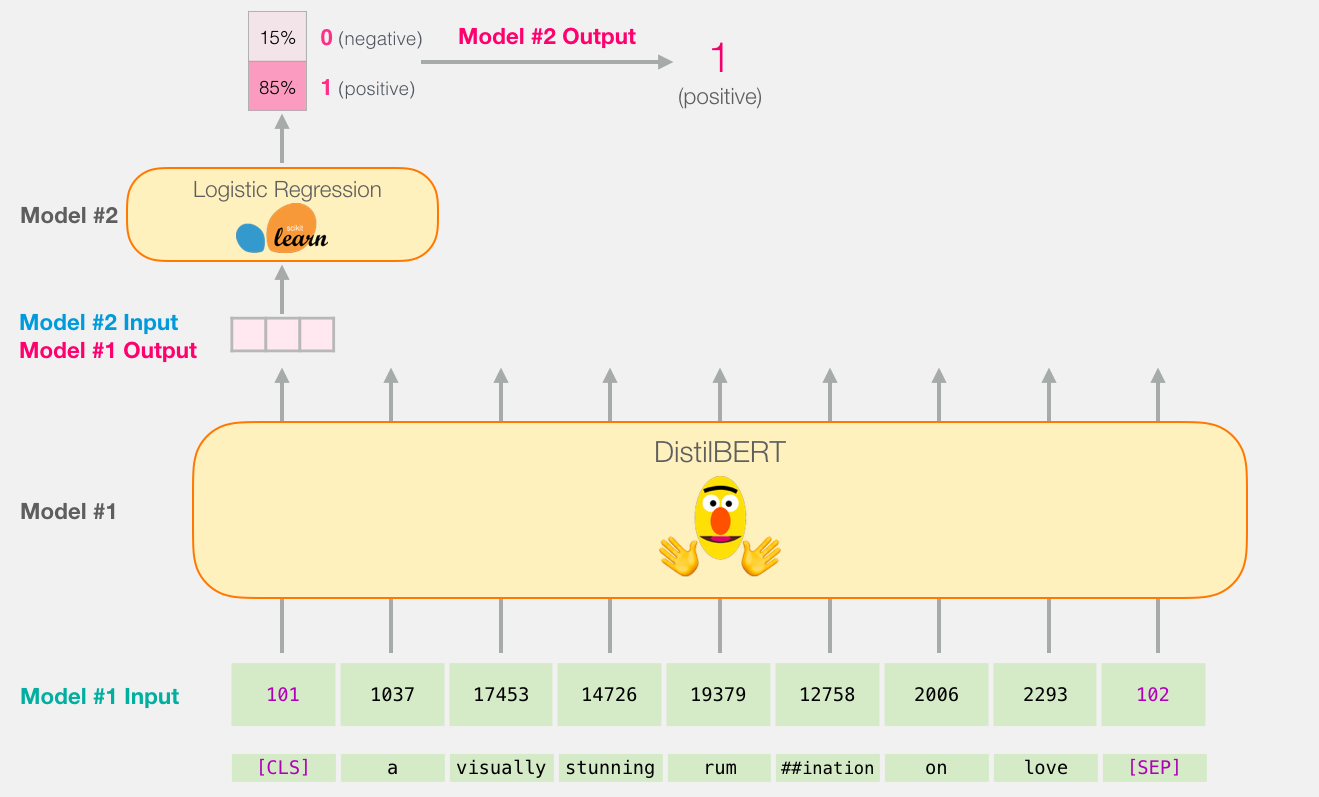

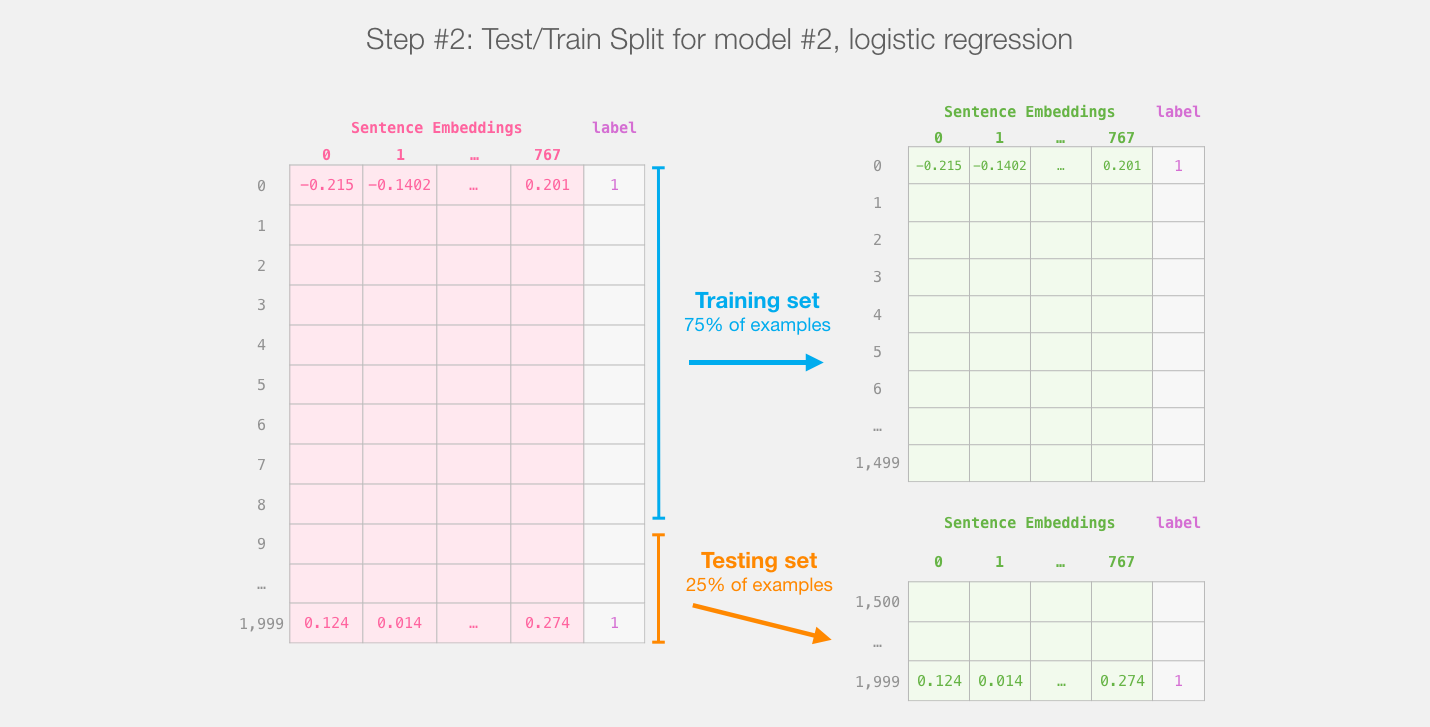

distilBERT' ( #1) , ( #2). , sklearn , , 75% ,

:

, , , .

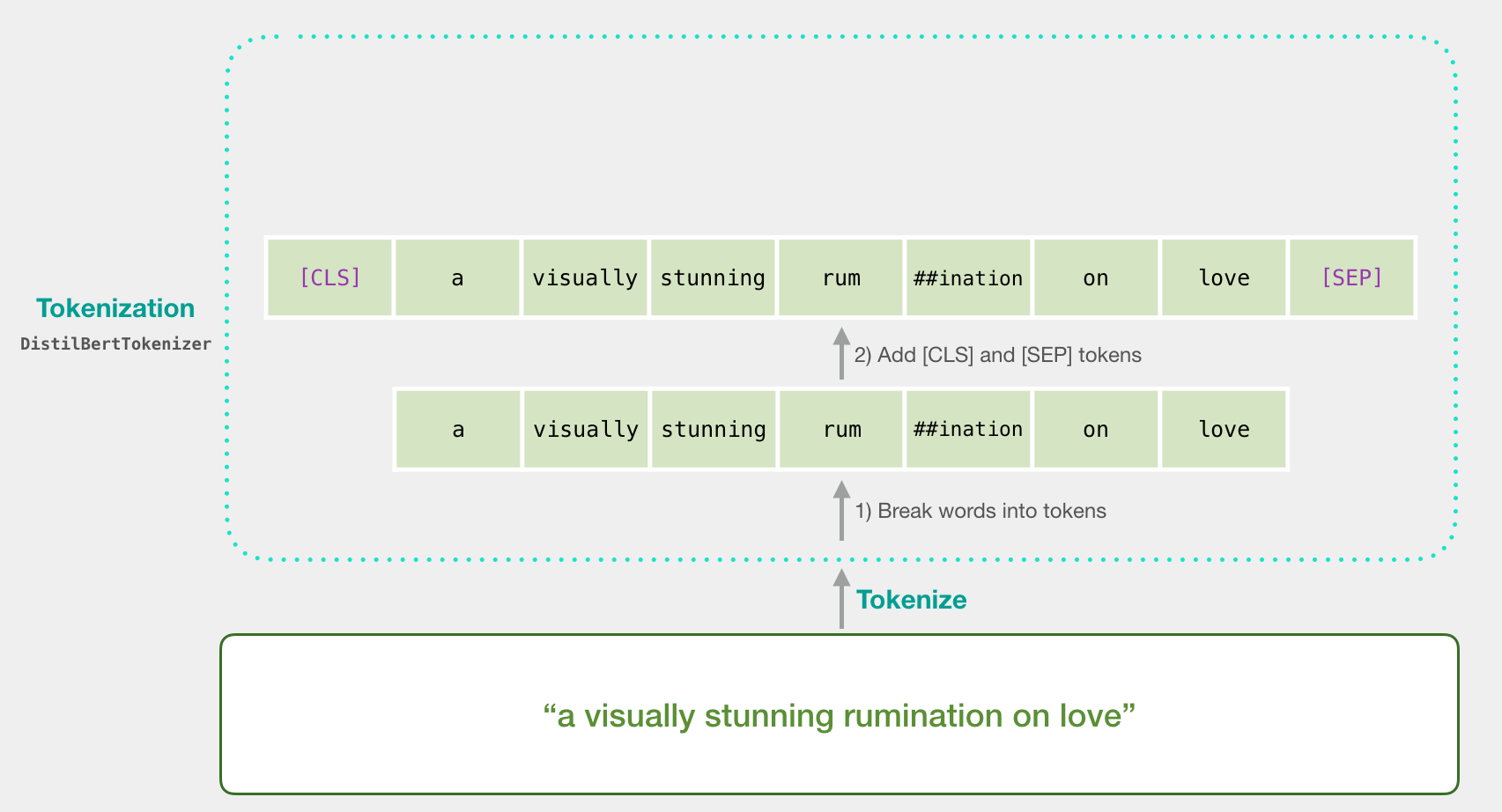

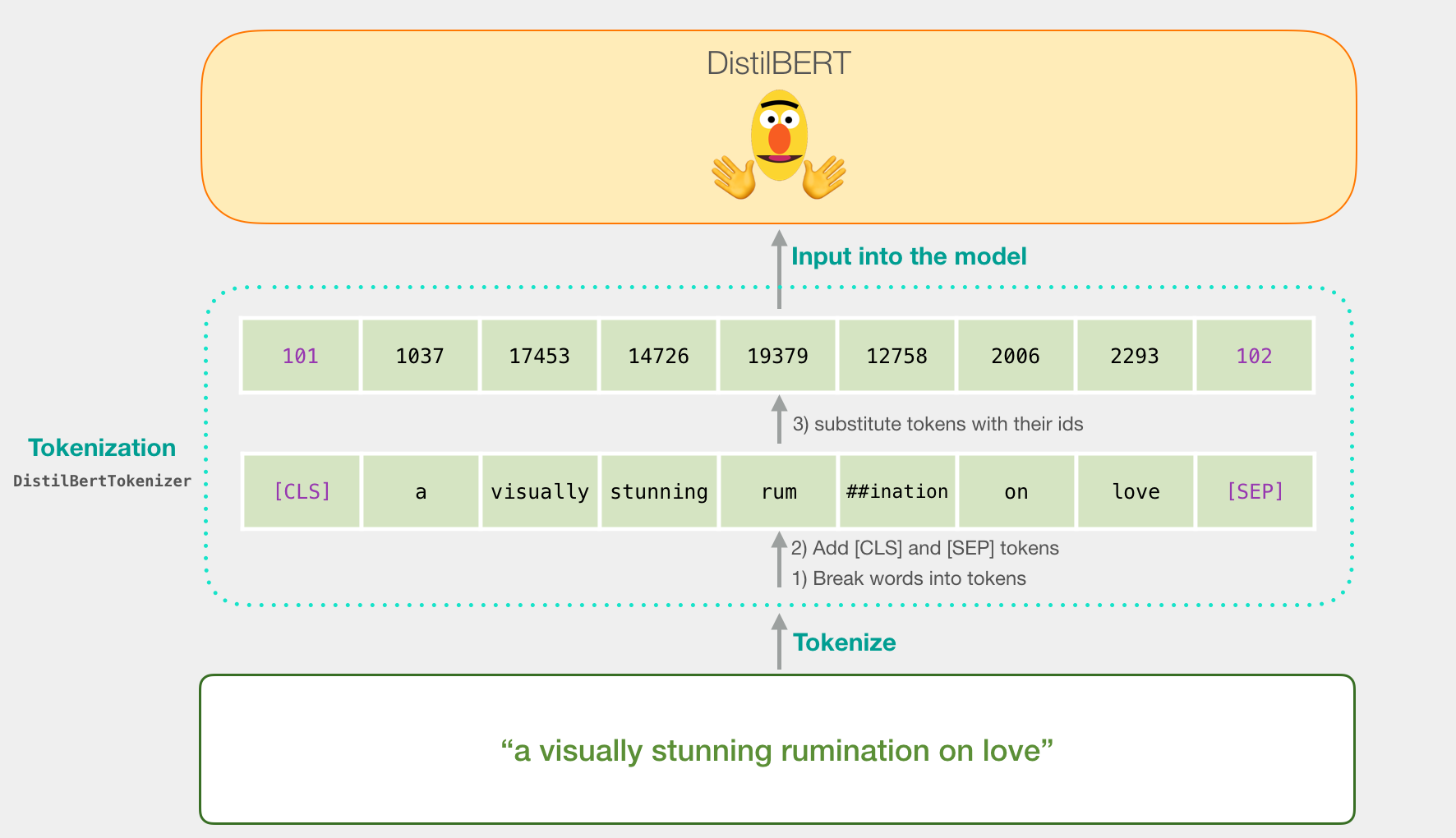

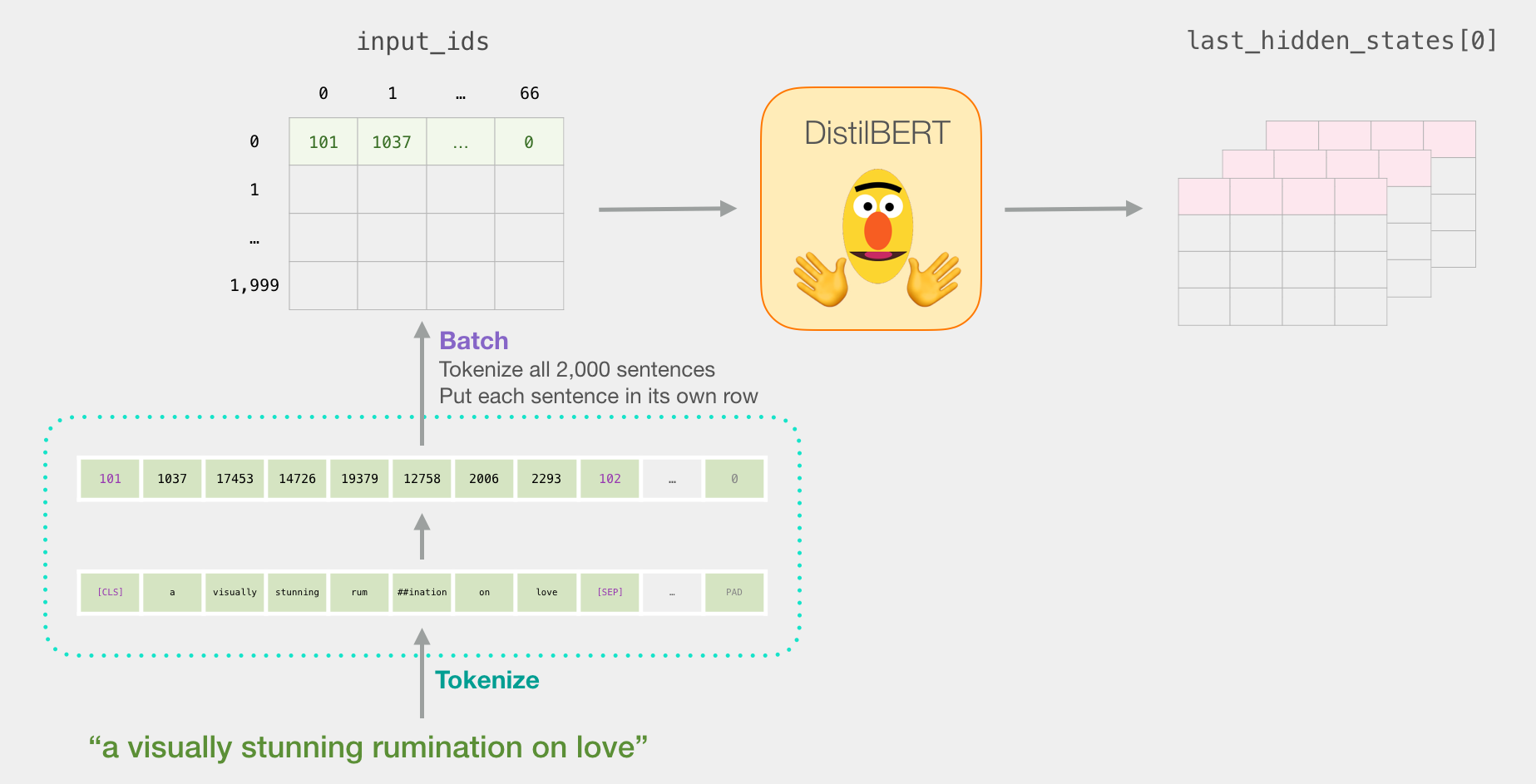

«a visually stunning rumination on love». BERT' , . , ( [CLS] [SEP] ).

, . Word2vec .

:

tokenizer.encode("a visually stunning rumination on love", add_special_tokens=True)

DistilBERT'.

BERT, ELMO ( NLP ), :

DistilBERT

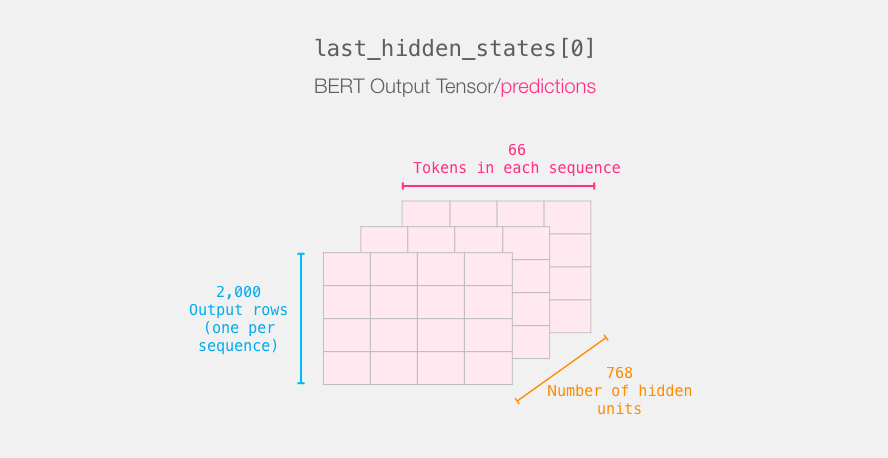

DistilBERT' , BERT'. , 768 .

, , ( [CLS] ). .

, , . :

, .

. Colab github.

:

import numpy as np

import pandas as pd

import torch

import transformers as ppb

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import cross_val_score

from sklearn.model_selection import train_test_split

github, pandas:

df = pd.read_csv('https://github.com/clairett/pytorch-sentiment-classification/raw/master/data/SST2/train.tsv', delimiter='\t', header=None)

df.head() , 5 , :

df.head()

DistilBERT

model_class, tokenizer_class, pretrained_weights = (ppb.DistilBertModel, ppb.DistilBertTokenizer, 'distilbert-base-uncased')

tokenizer = tokenizer_class.from_pretrained(pretrained_weights)

model = model_class.from_pretrained(pretrained_weights)

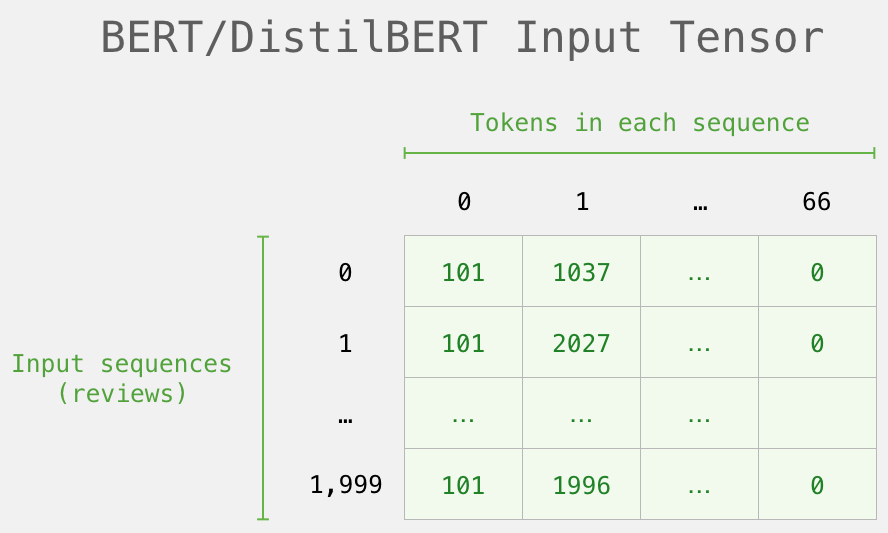

. , , . . ( , 2000).

tokenized = df[0].apply((lambda x: tokenizer.encode(x, add_special_tokens=True)))

.

( Series/DataFrame pandas) . DistilBERT , 0 (padding). , ( , Python).

, /, BERT':

DistilBERT'

DistilBERT.

input_ids = torch.tensor(np.array(padded))

with torch.no_grad():

last_hidden_states = model(input_ids)

last_hidden_states DistilBERT', ( , , DistilBERT). , 2000 (.. 2000 ), 66 ( 2000 ), 278 ( DistilBERT).

BERT'

3-d . :

. :

BERT' [CLS]. .

, 3d , 2d :

features = last_hidden_states[0][:,0,:].numpy()

features 2d numpy, .

, BERT'

, BERT', , . 768 , .

, . BERT' [CLS] ( #0), (. ). , – , BERT/DistilBERT

, , .

labels = df[1]

train_features, test_features, train_labels, test_labels = train_test_split(features, labels)

:

.

lr_clf = LogisticRegression()

lr_clf.fit(train_features, train_labels)

, .

lr_clf.score(test_features, test_labels)

, (accuracy) – 81%.

: – 96.8. DistilBERT , – , . BERT , ( downstream task). DistilBERT' 90.7. BERT' 94.9.

Colab.

बस इतना ही! एक अच्छा पहला परिचित हुआ। अगला कदम प्रलेखन की ओर मुड़ना और अपने हाथों को ठीक करने की कोशिश करना है। आप थोड़ा पीछे भी जा सकते हैं और डिस्टिलबर्ट से बीईआरटी तक जा सकते हैं और देख सकते हैं कि यह कैसे काम करता है।

धन्यवाद करने के लिए मेहरबान Delangue , विक्टर Sanh , और Huggingface टीम है जो इस गाइड के पहले के संस्करणों पर अपनी प्रतिक्रिया दी है।

लेखक