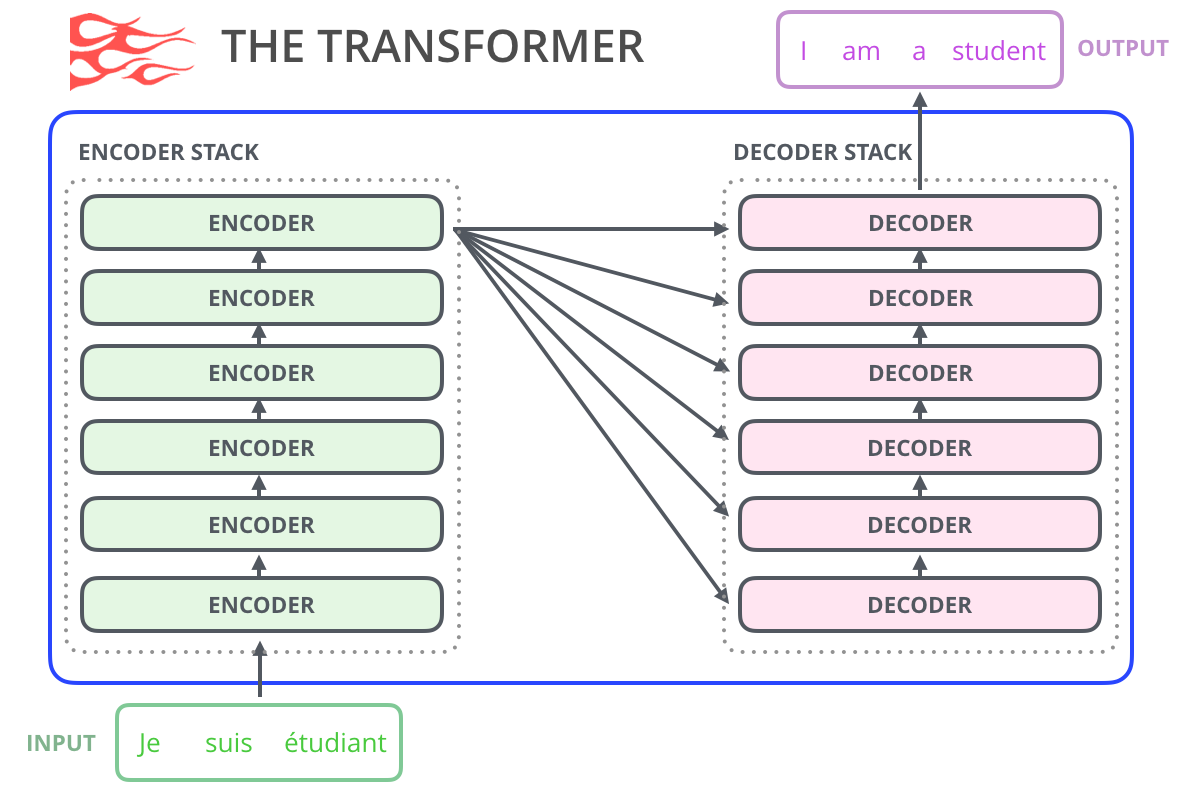

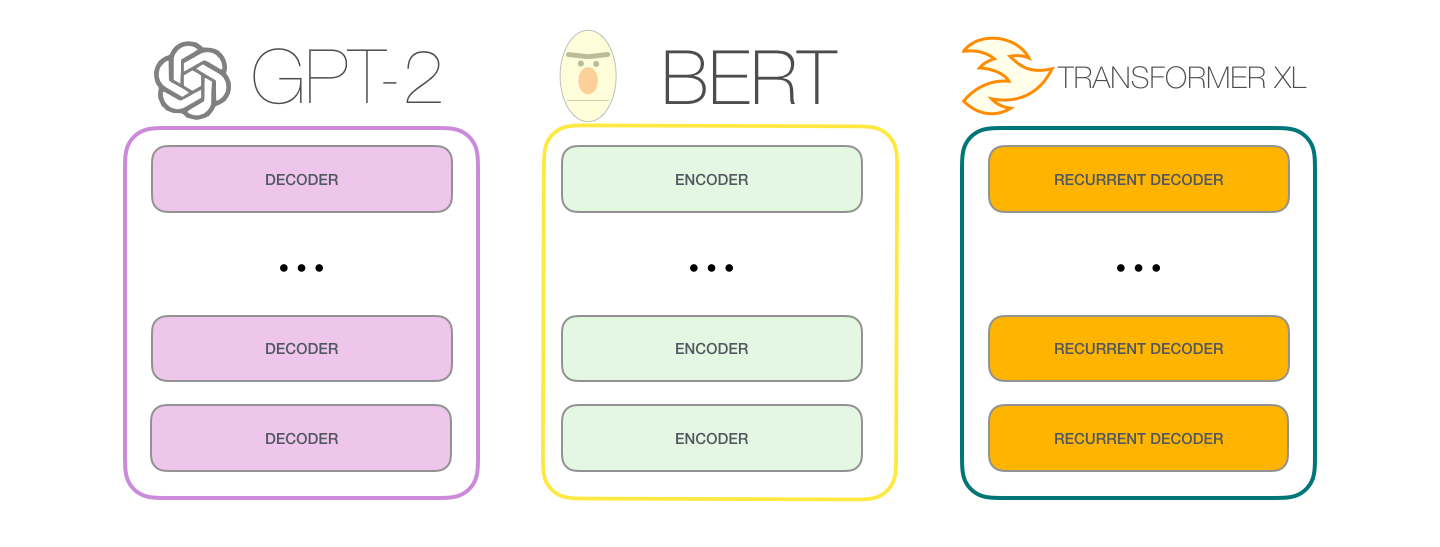

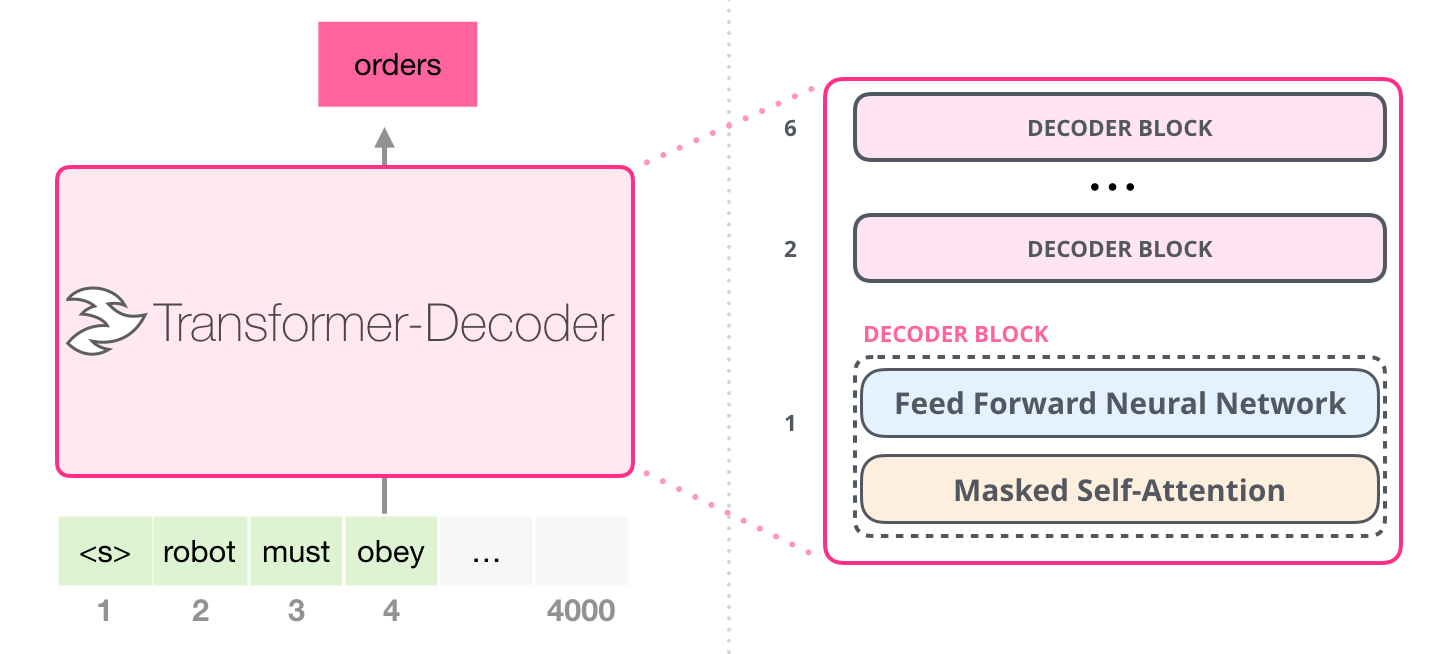

2019 में, हमने मशीन लर्निंग के शानदार उपयोग को देखा। OpenAI GPT-2 मॉडल ने सुसंगत और भावनात्मक ग्रंथों को लिखने की एक प्रभावशाली क्षमता का प्रदर्शन किया है जो आधुनिक भाषा के मॉडल को उत्पन्न करने के बारे में हमारी समझ से बेहतर है। GPT-2 कुछ विशेष रूप से नया आर्किटेक्चर नहीं है - यह ट्रांसफॉर्मर-डिकोडर (डिकोडर-ओनली ट्रांसफॉर्मर) की बहुत याद दिलाता है। GPT-2 के बीच अंतर यह है कि यह ट्रांसफॉर्मर पर आधारित एक बहुत बड़ा भाषा मॉडल है, जो एक प्रभावशाली डेटा सेट पर प्रशिक्षित है। इस लेख में, हम उस मॉडल की वास्तुकला को देखेंगे जो हमें ऐसे परिणाम प्राप्त करने की अनुमति देता है: हम विस्तार से आत्म-ध्यान की परत और डिकोडिंग ट्रांसफार्मर का उपयोग उन कार्यों के लिए करेंगे जो भाषा मॉडलिंग से परे हैं।

सामग्री

1: GPT-2

?

Word2vec , – , , . – , .

, GPT-2 , , , . GPT-2 40 (WebText), OpenAI . , , SwiftKey, 78 , GPT-2 500 , GPT-2 – 13 ( 6,5 ).

GPT-2 AllenAI GPT-2 Explorer. GPT-2 ( ), .

, – .. . – , - .

, , , , ( AlphaStar).

? , GPT-2 :

BERT'

:

, .

GPT-2 . BERT , , . . , GPT-2, , . , GPT-2 :

: , , . . «» (auto-regression) RNN .

GPT-2 TransformerXL XLNet . BERT . . , BERT . XLNet , .

.

– :

(, 512 ). , .

– , . :

, [mask] , BERT', , , .

, , #4, , :

, BERT, GPT-2. . :

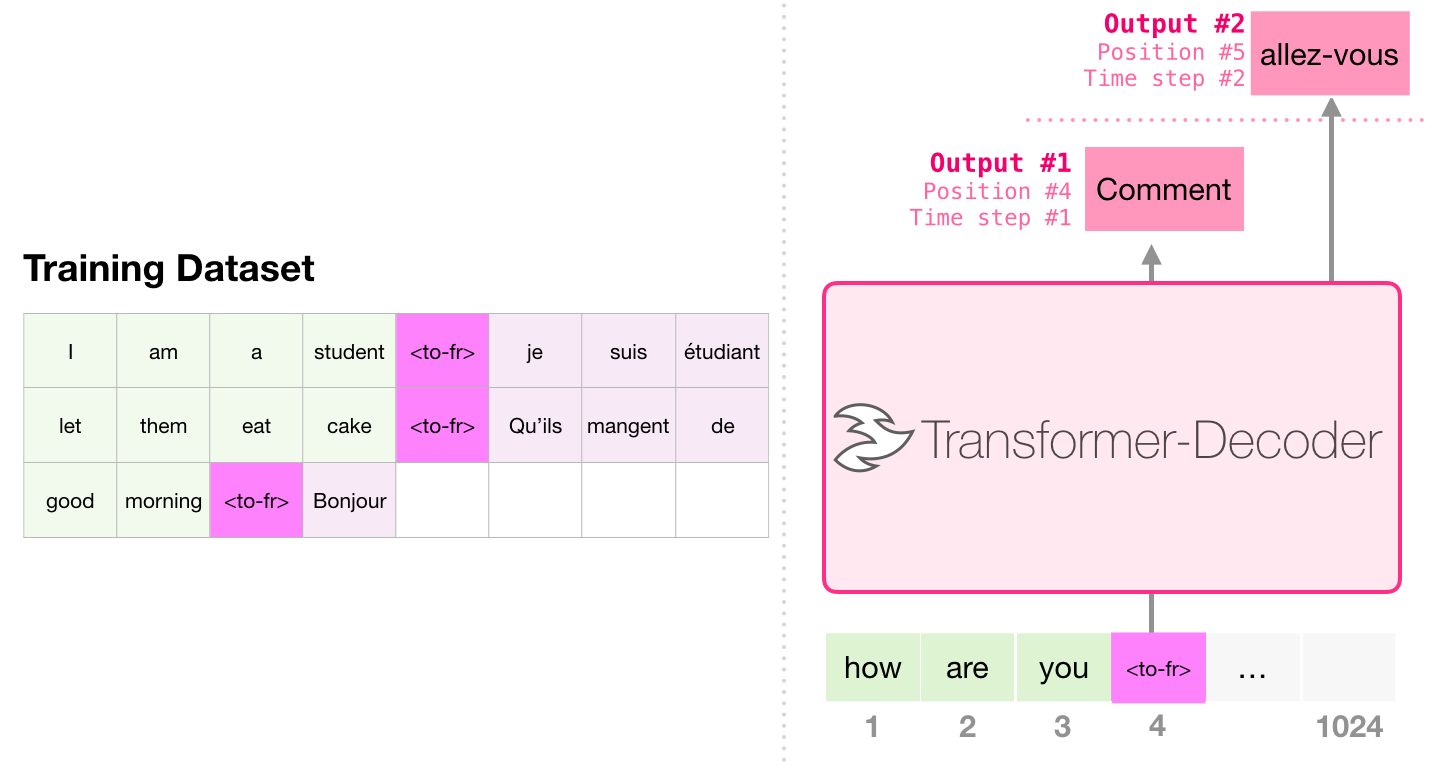

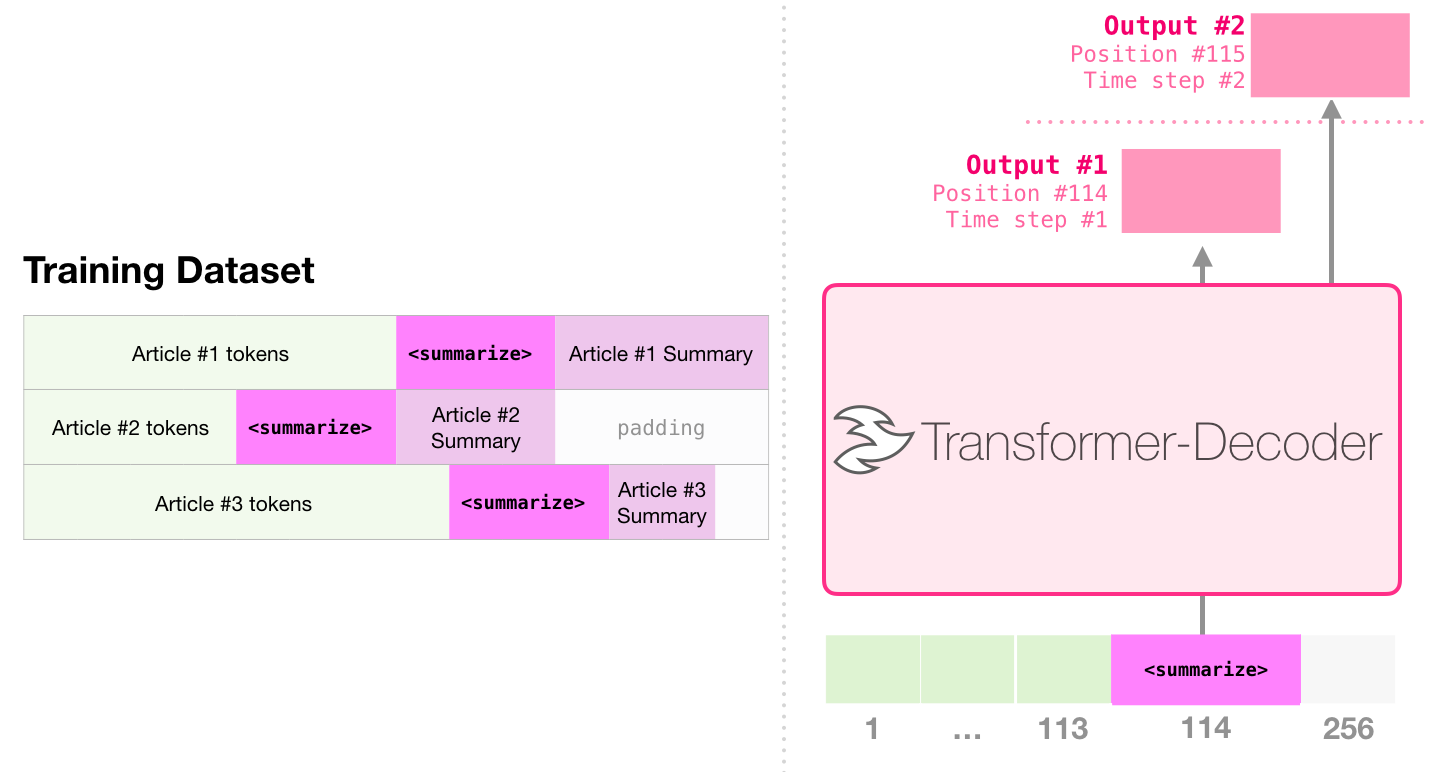

, «Generating Wikipedia by Summarizing Long Sequences» , : . «-». 6 :

. , . , 4000 – 512 .

, , . « », / .

GPT-2 OpenAI .

- : GPT-2

, , . , , , , . (Budgie)

GPT-2 , .

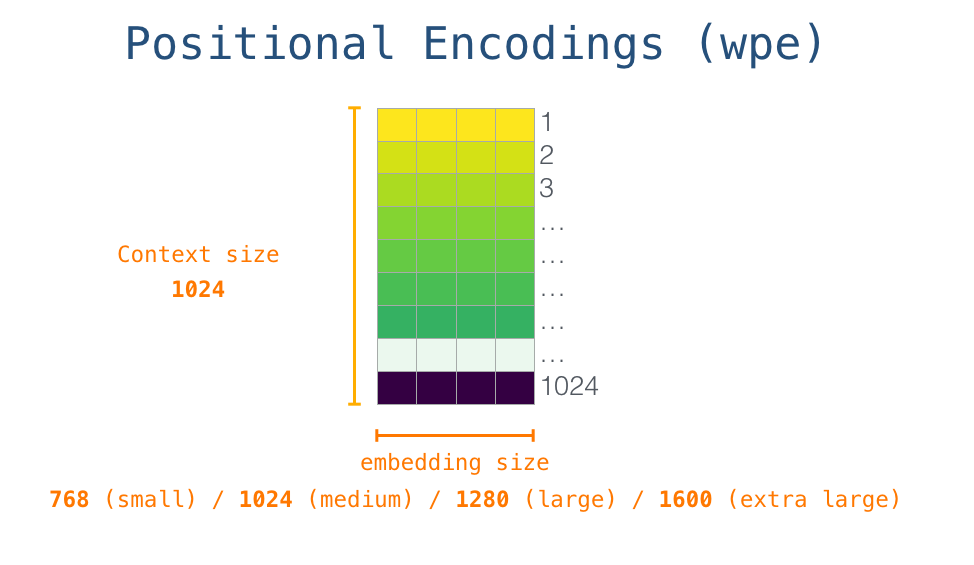

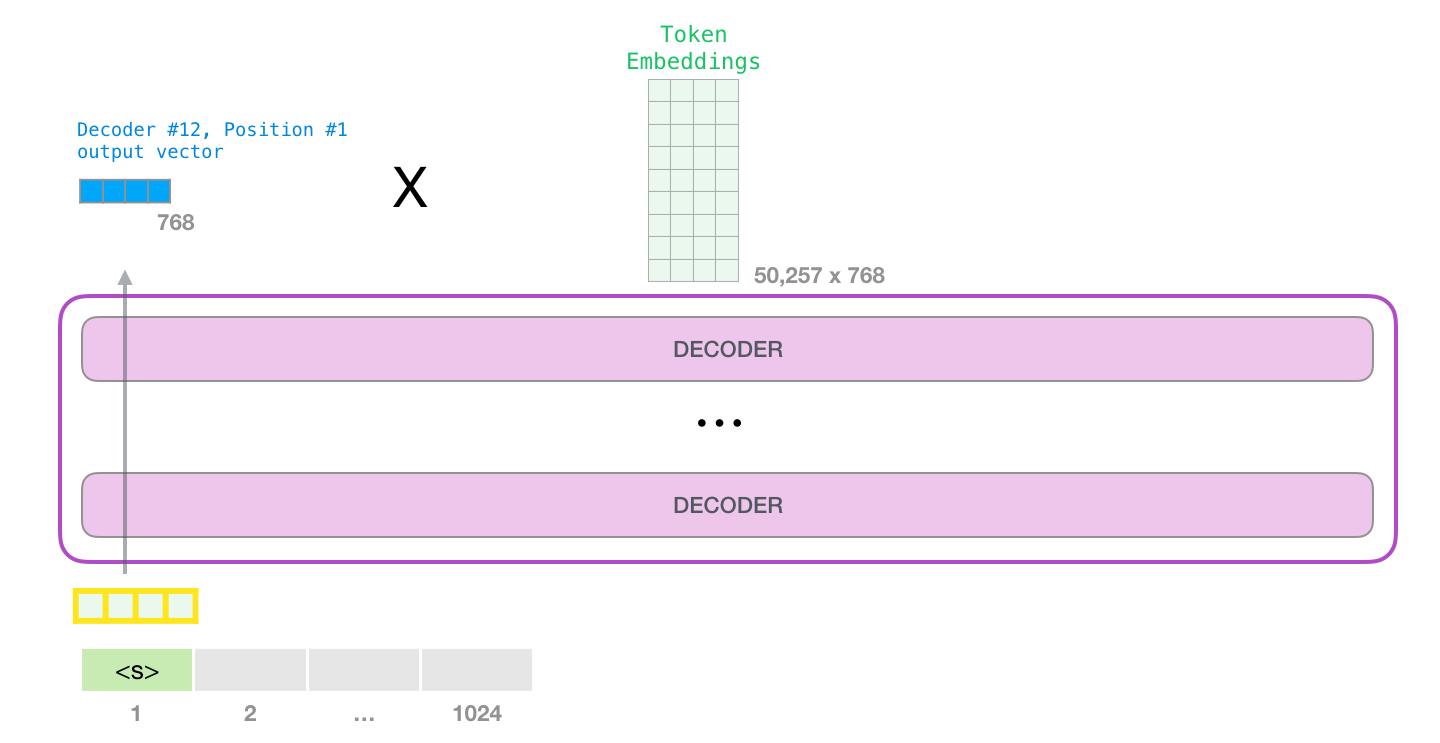

GPT-2 1024 . .

GPT-2 – ( ) (), (.. ). , ( <|endoftext|>; <|s|>).

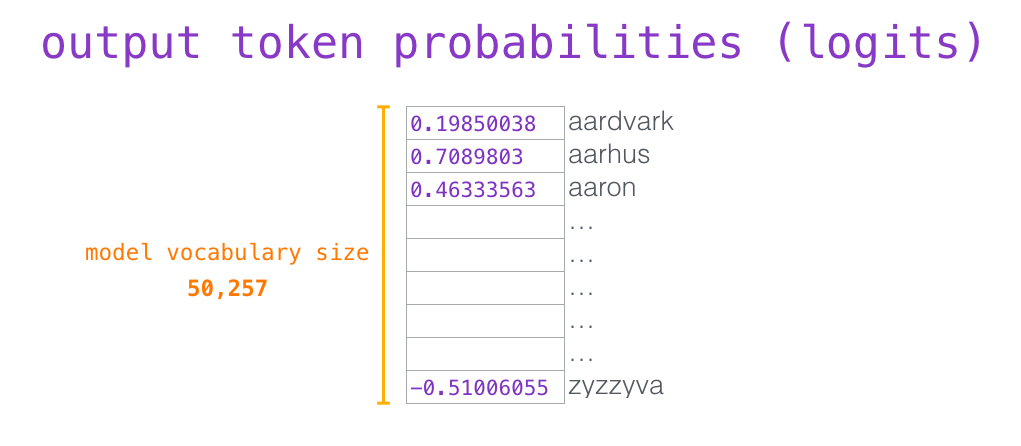

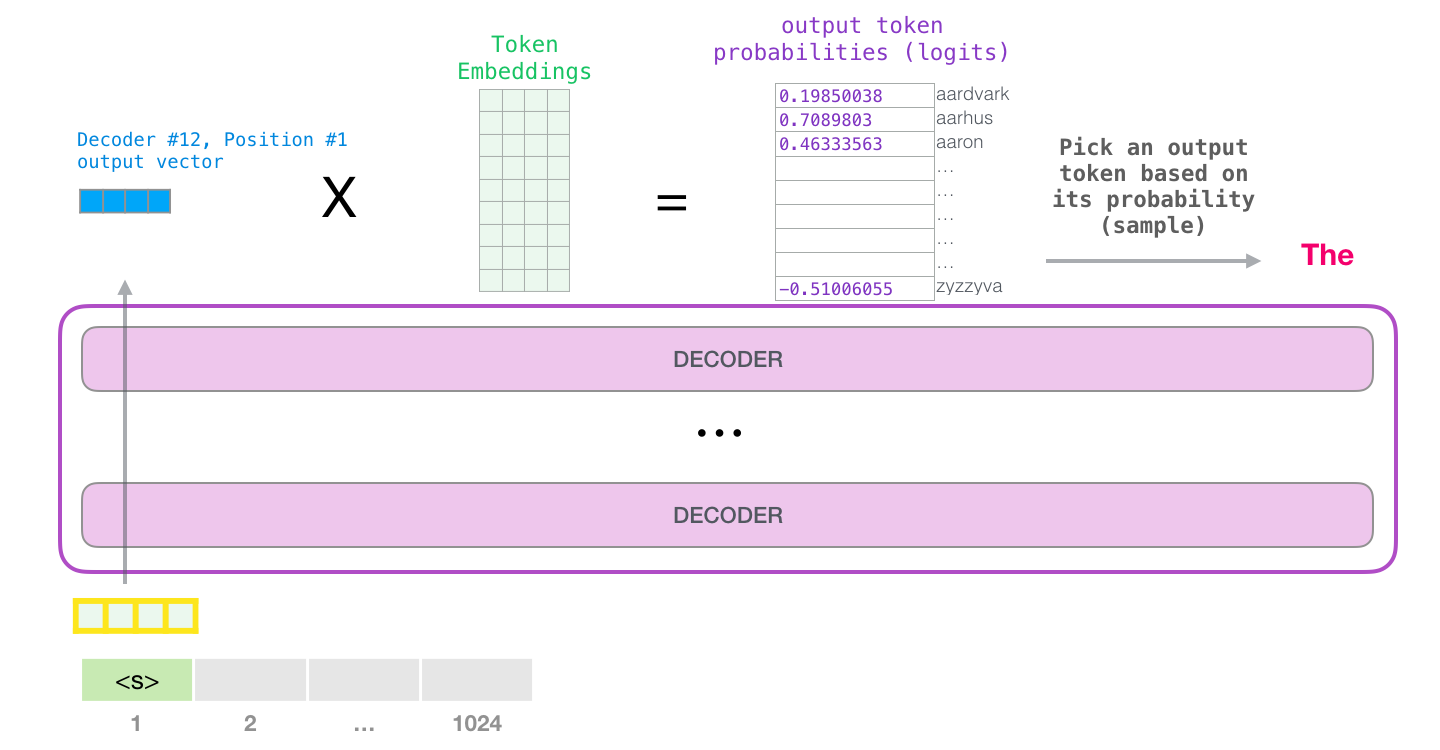

, . , (score) – , (50 GPT-2). – «the». - – , , , , – . . GPT-2 top-k, , , (, , top-k = 1).

:

, . GPT-2 ( ). GPT-2 .

. . NLP-, , – , .

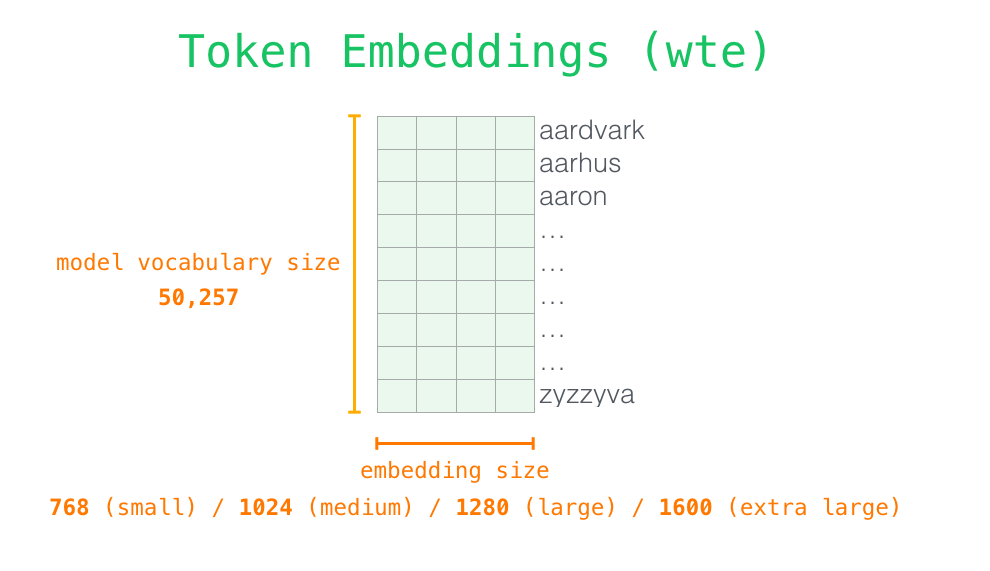

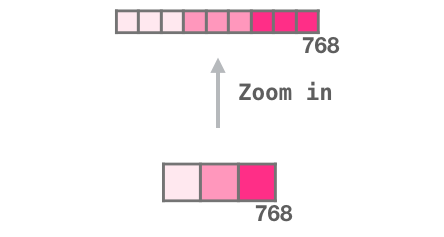

– , - . GPT-2. 768 /.

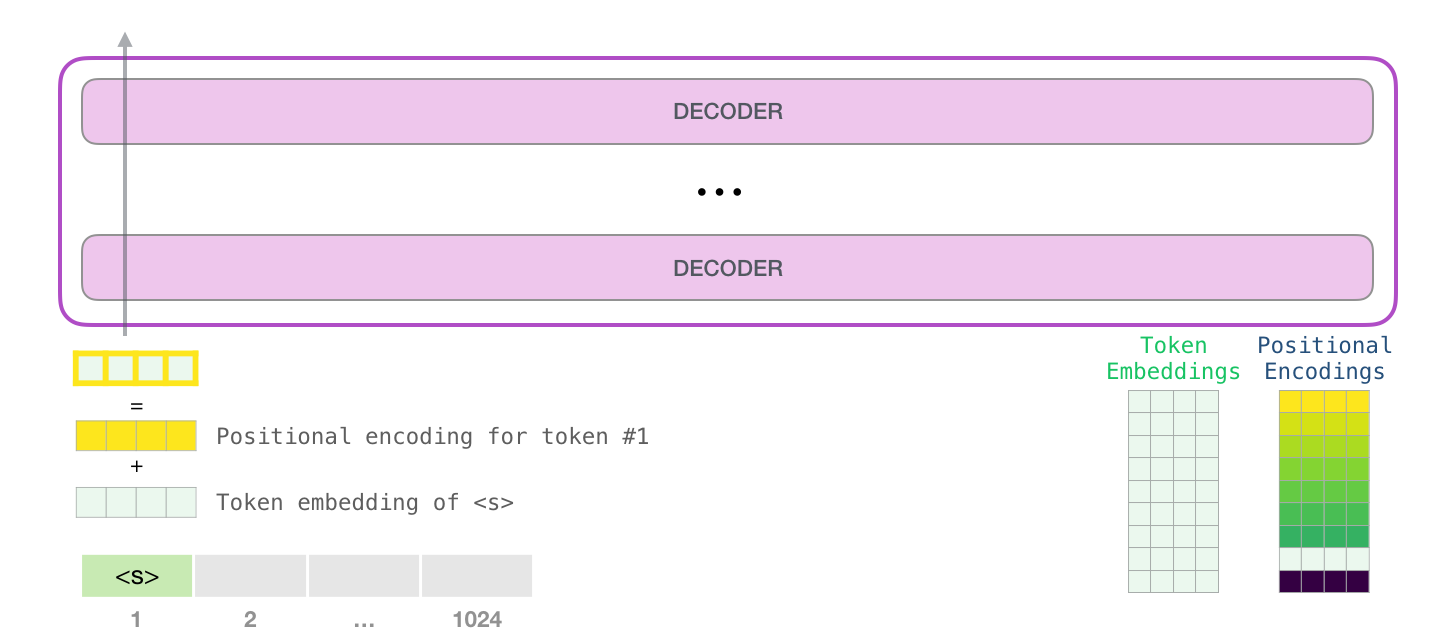

, <|s|> . , – , . , 1024 .

. , GPT-2.

#1.

, , . , . , , .

. , :

, , , .

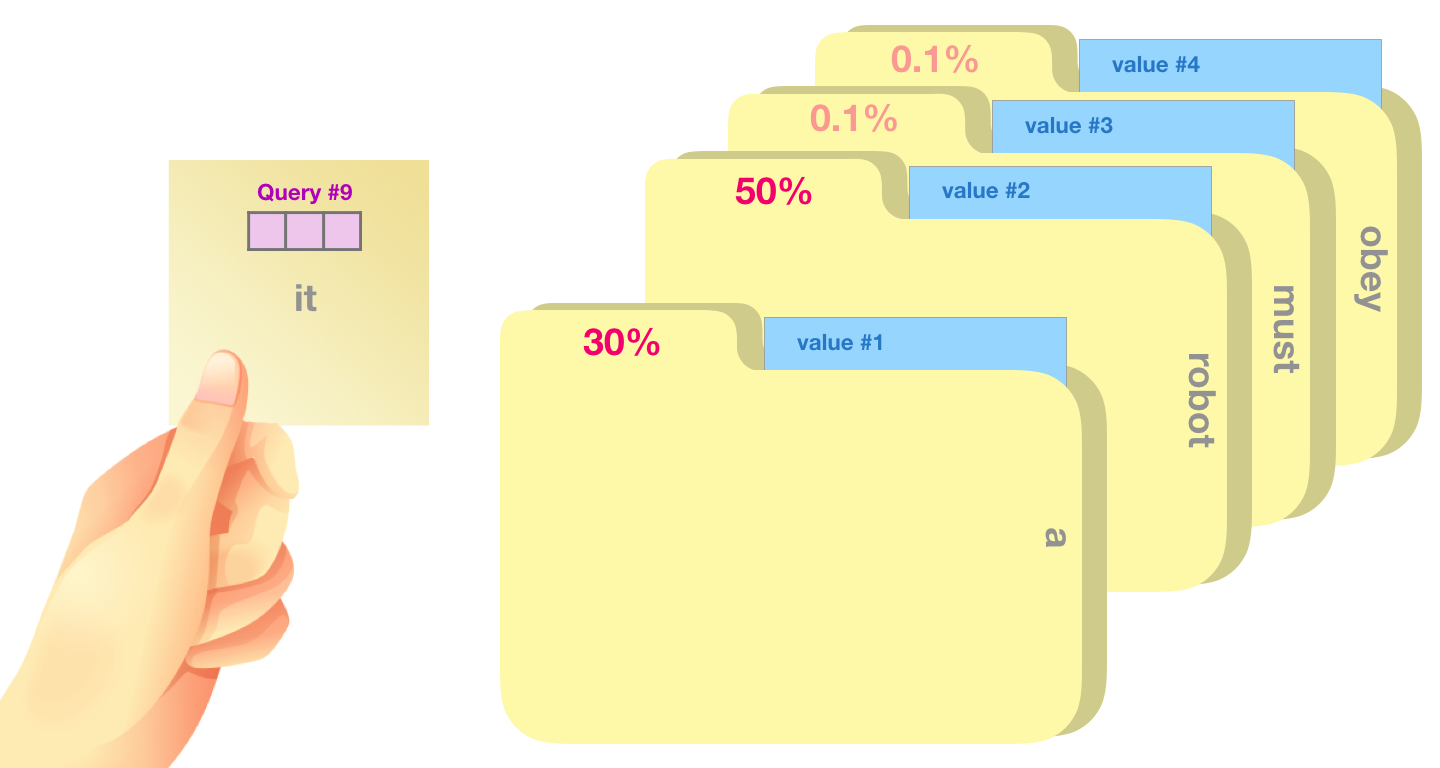

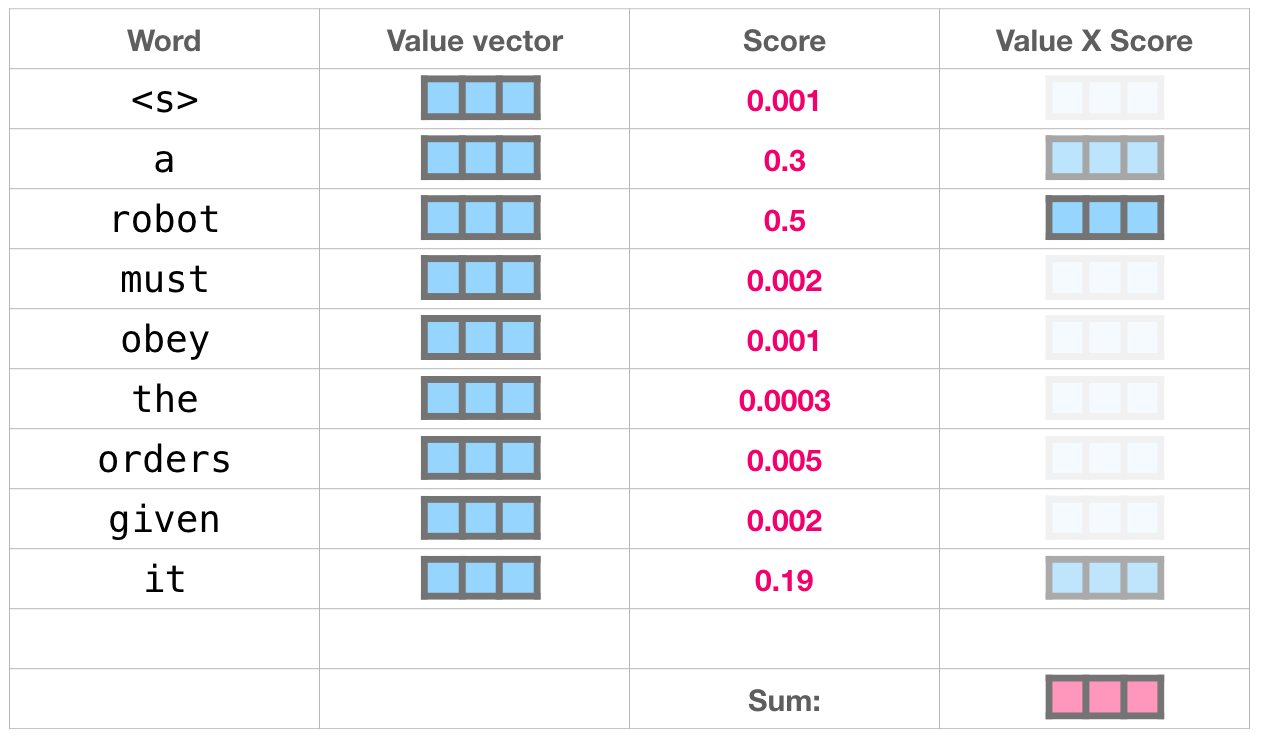

, . , . , , :

: , , ( ). , , .

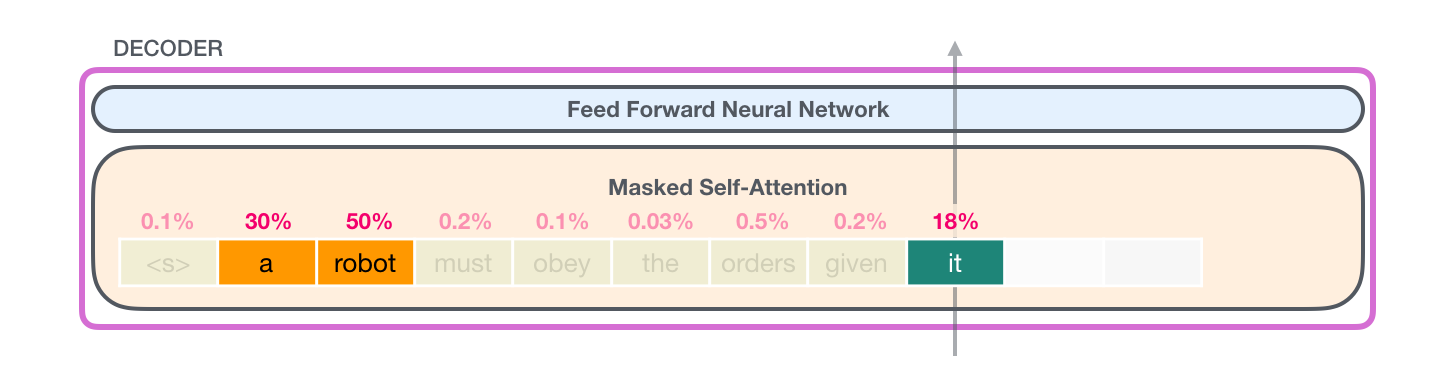

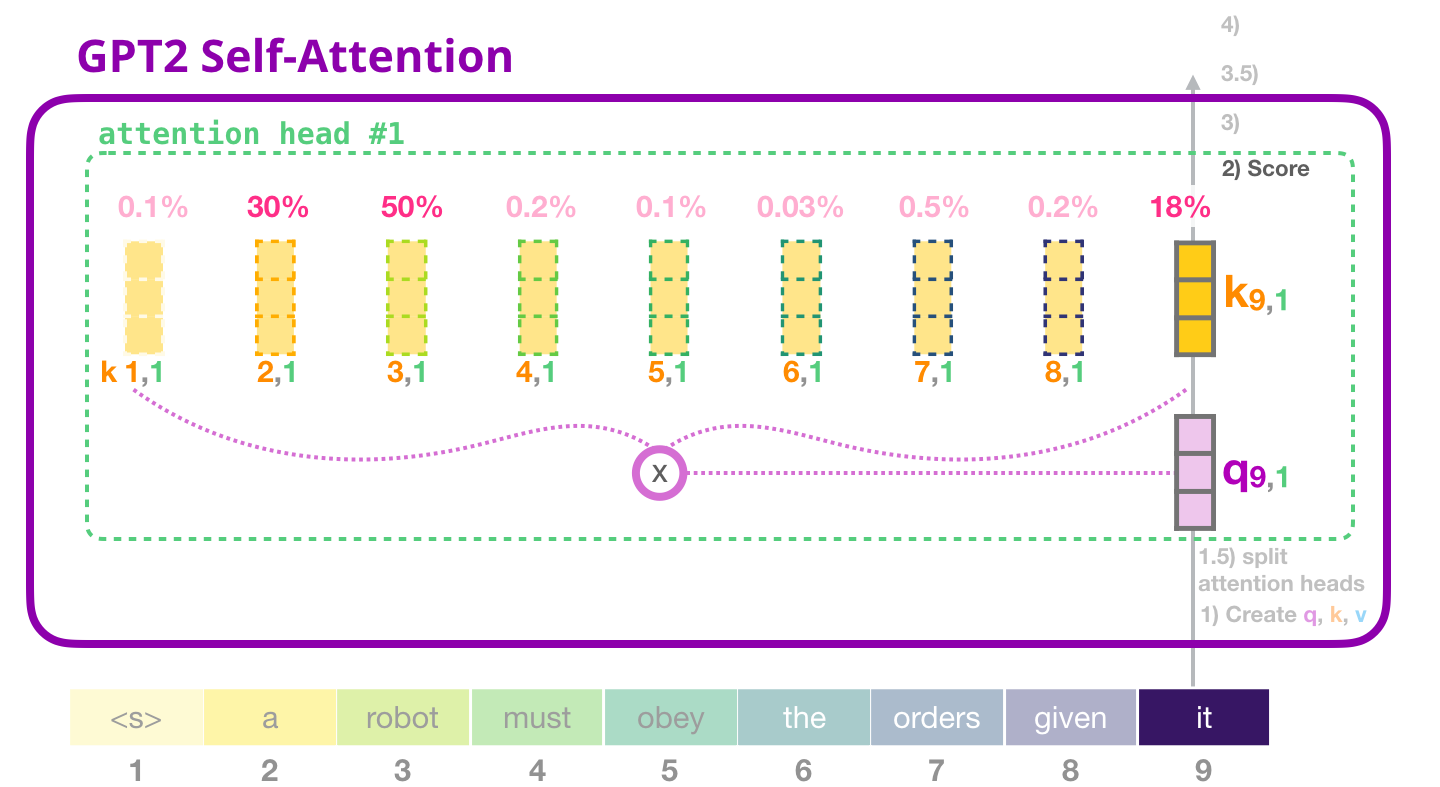

, «a robot» «it». , , , .

. :

- – , ( ). , ;

- – . ;

- – ; , , .

. – , . . , – . , .

(: ).

, .

, 50% «robot», 30% «a» 19% – «it». . .

( ), .

, . .

(top_k = 1). , . , , ( ). – top_k 40: 40 .

, . , (1024 ) .

: GPT-2,

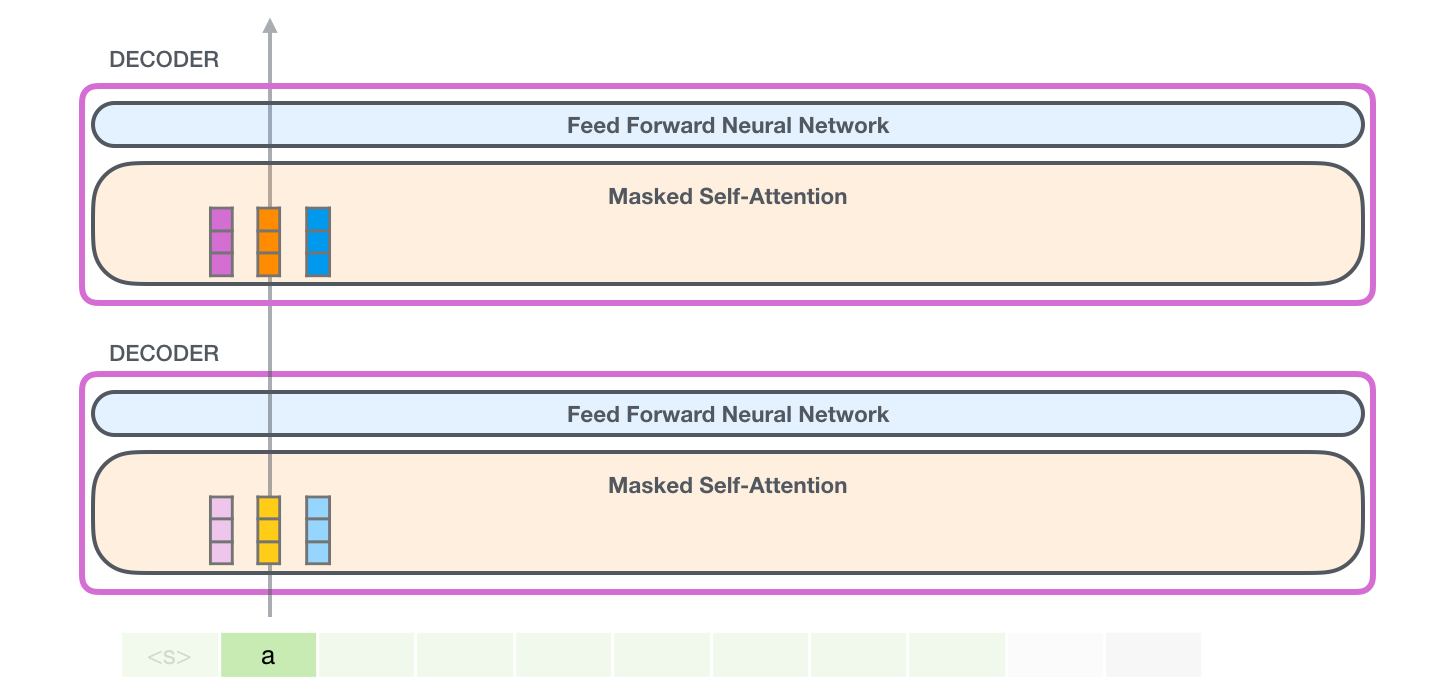

, , GPT-2. , , . , ( TransformerXL XLNet).

, :

- «» «» ; GPT-2 (Byte Pair Encoding) . , .

- GPT-2 / (inference/evaluation mode). . . (512), 1, .

- / . .

- , . Transformer , .

- . «zoom in», :

2:

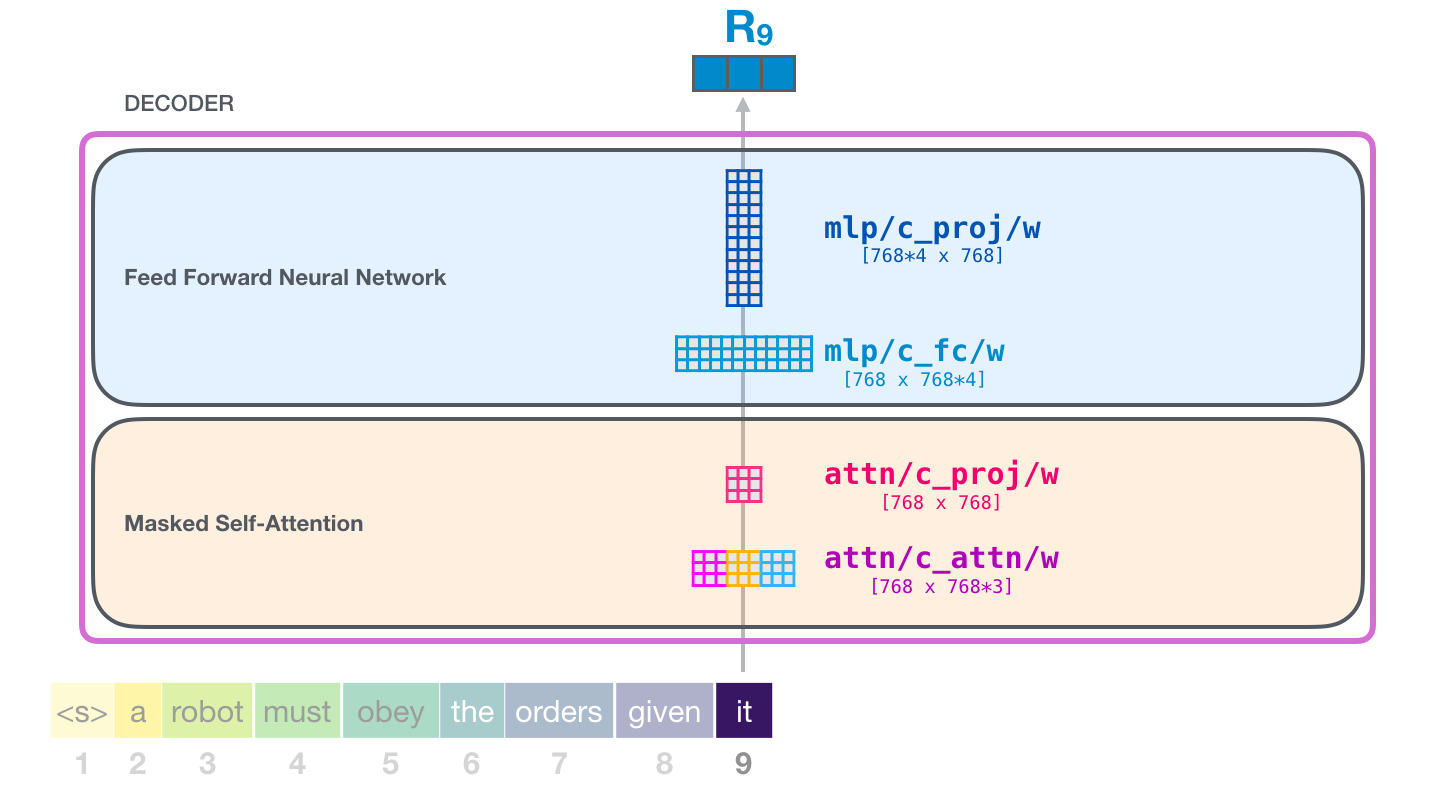

, «it»:

, . , , . , , .

( )

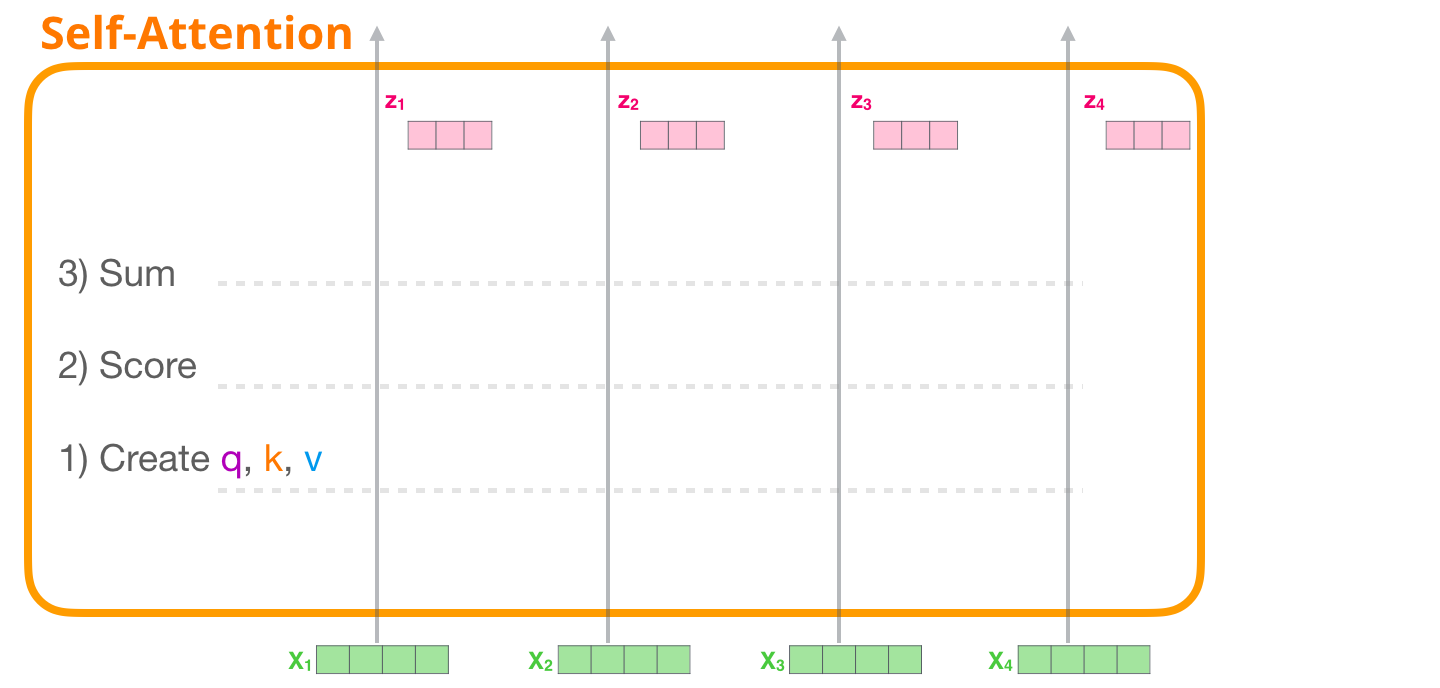

, . , 4 .

:

- , ;

- ;

- .

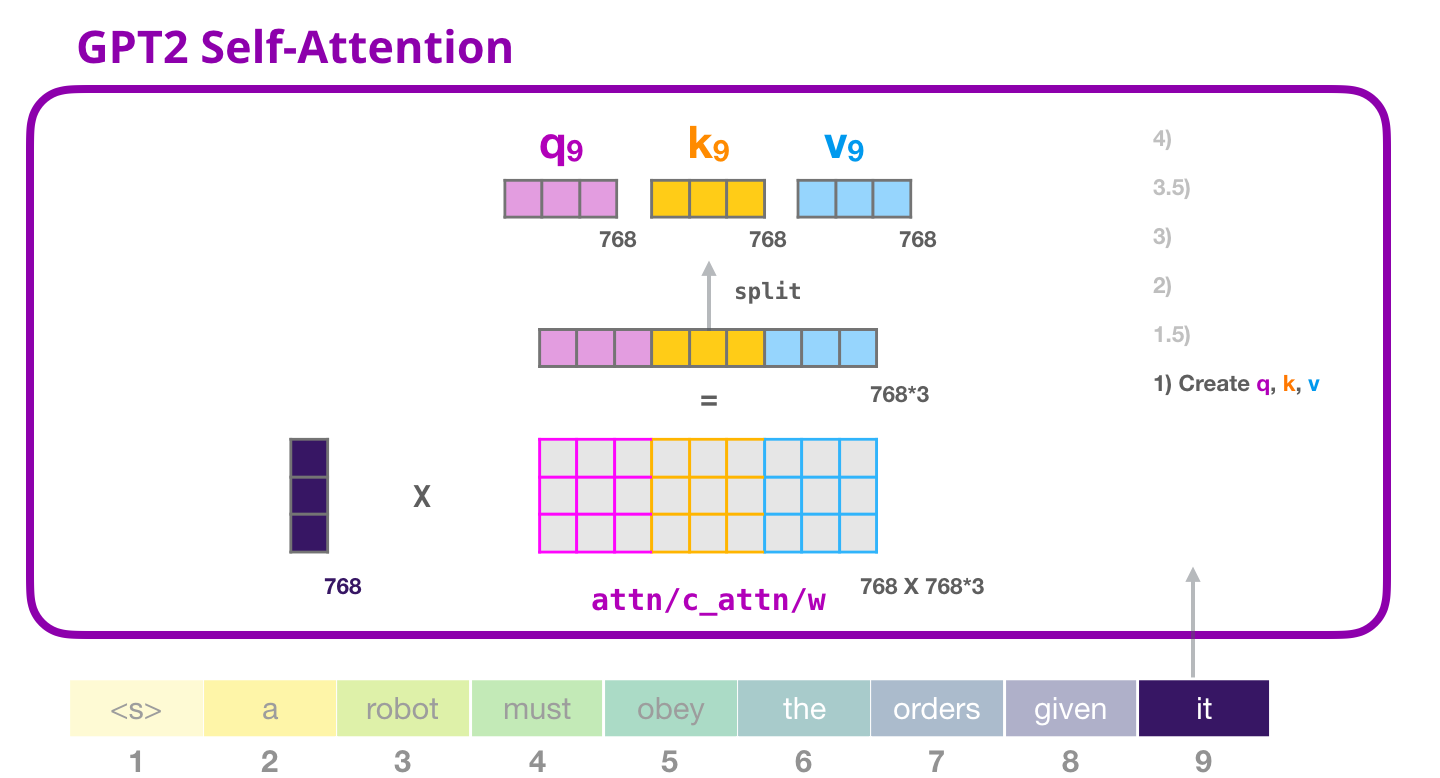

1 – ,

. . . ( «» ):

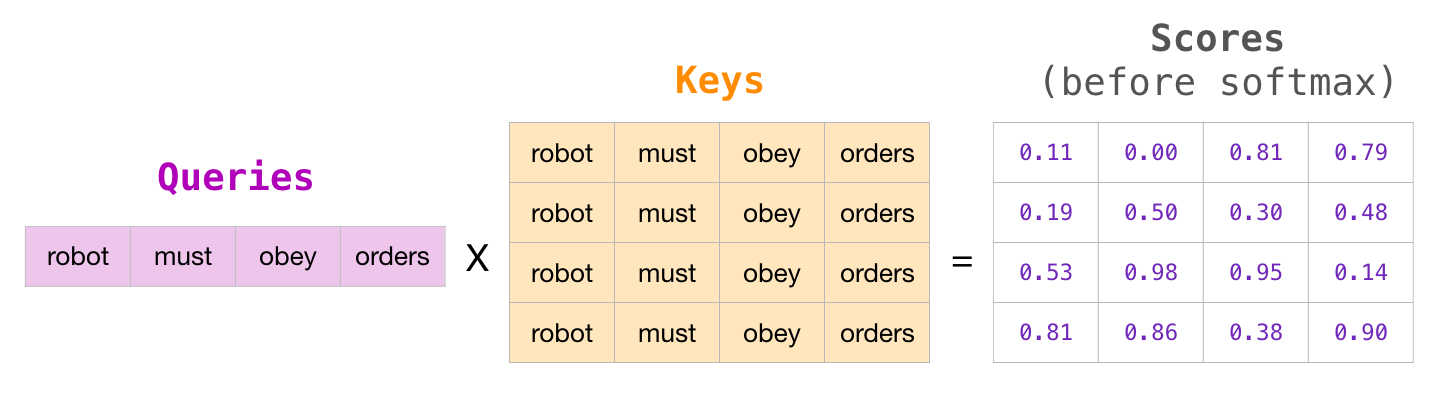

, WQ, WK, WV

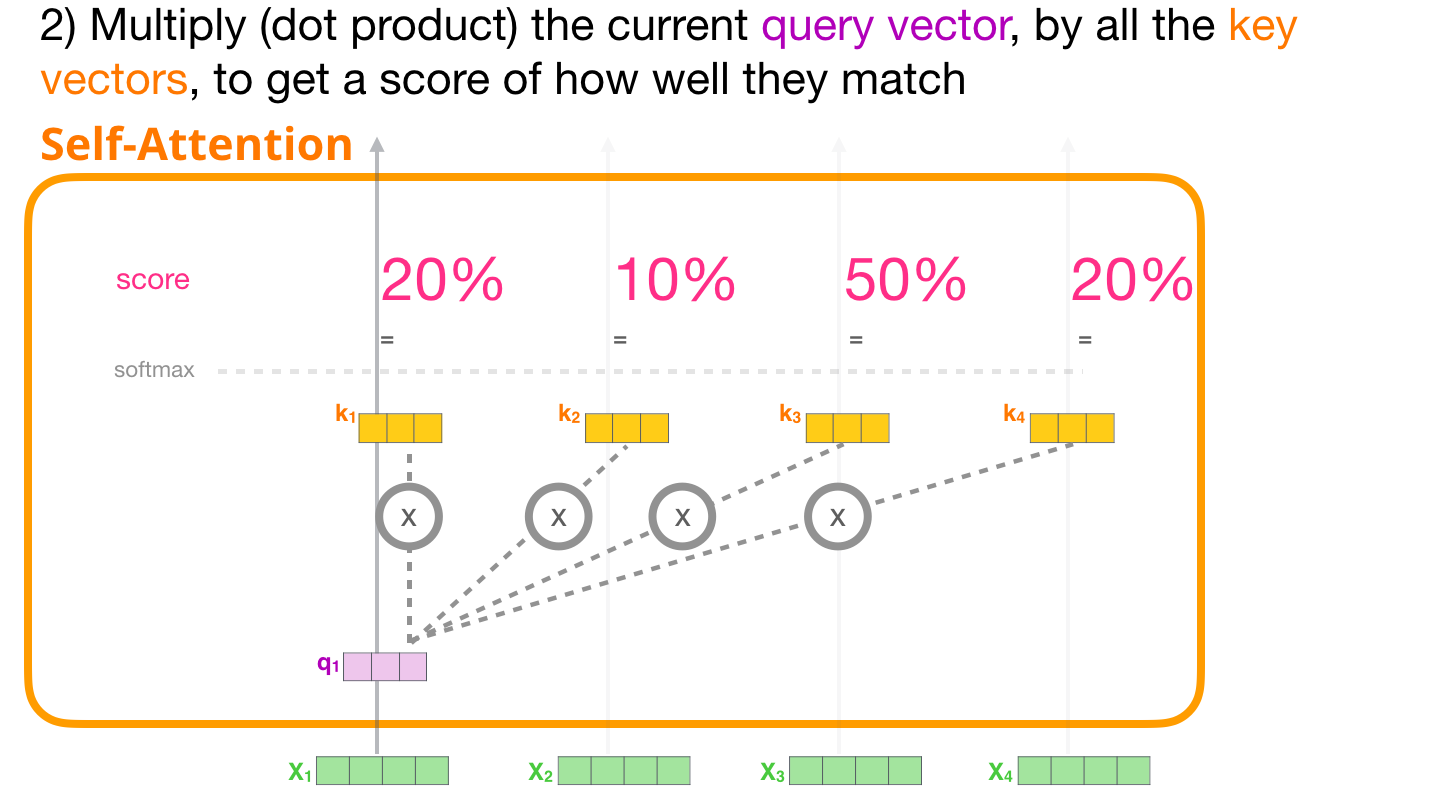

2 –

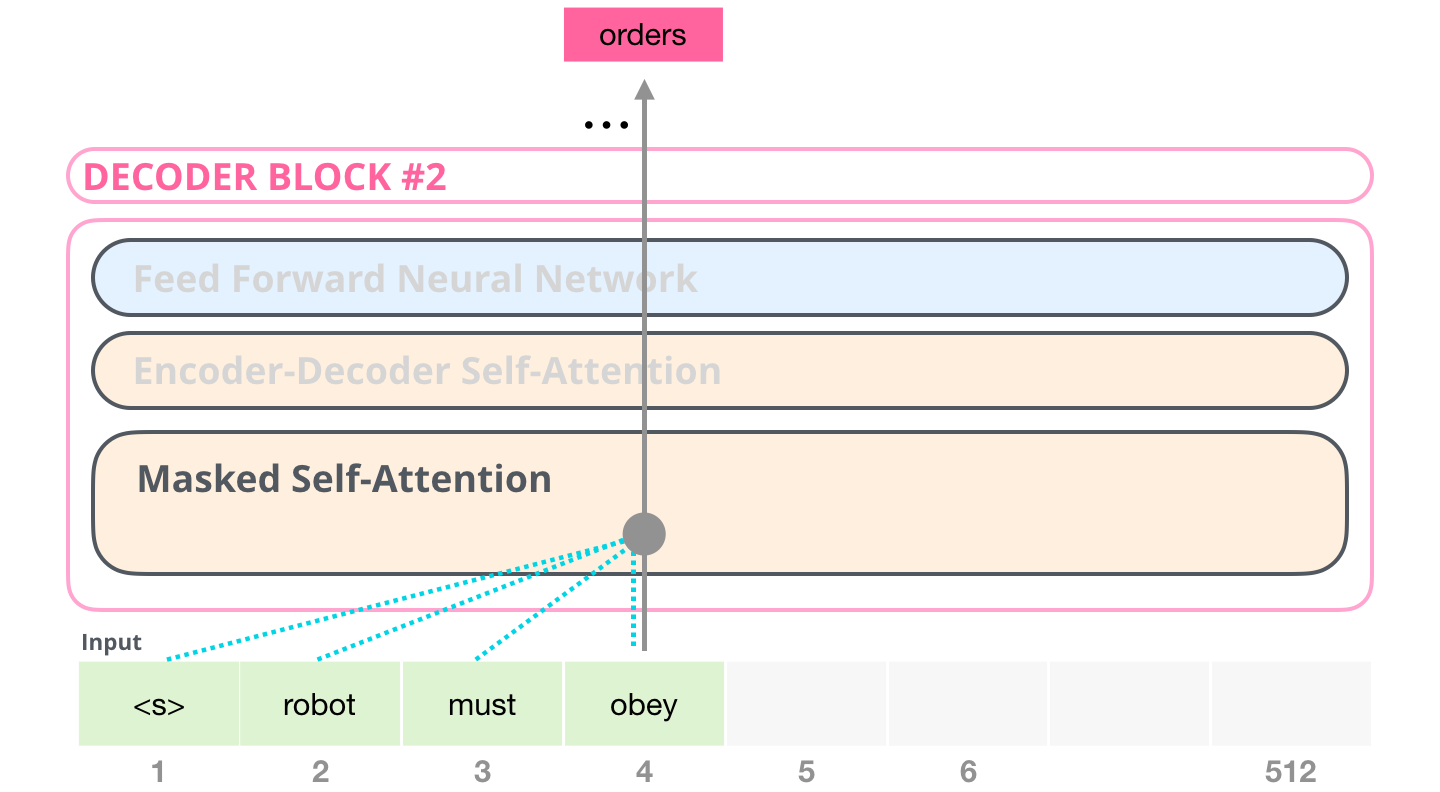

, , №2: .

( ) ,

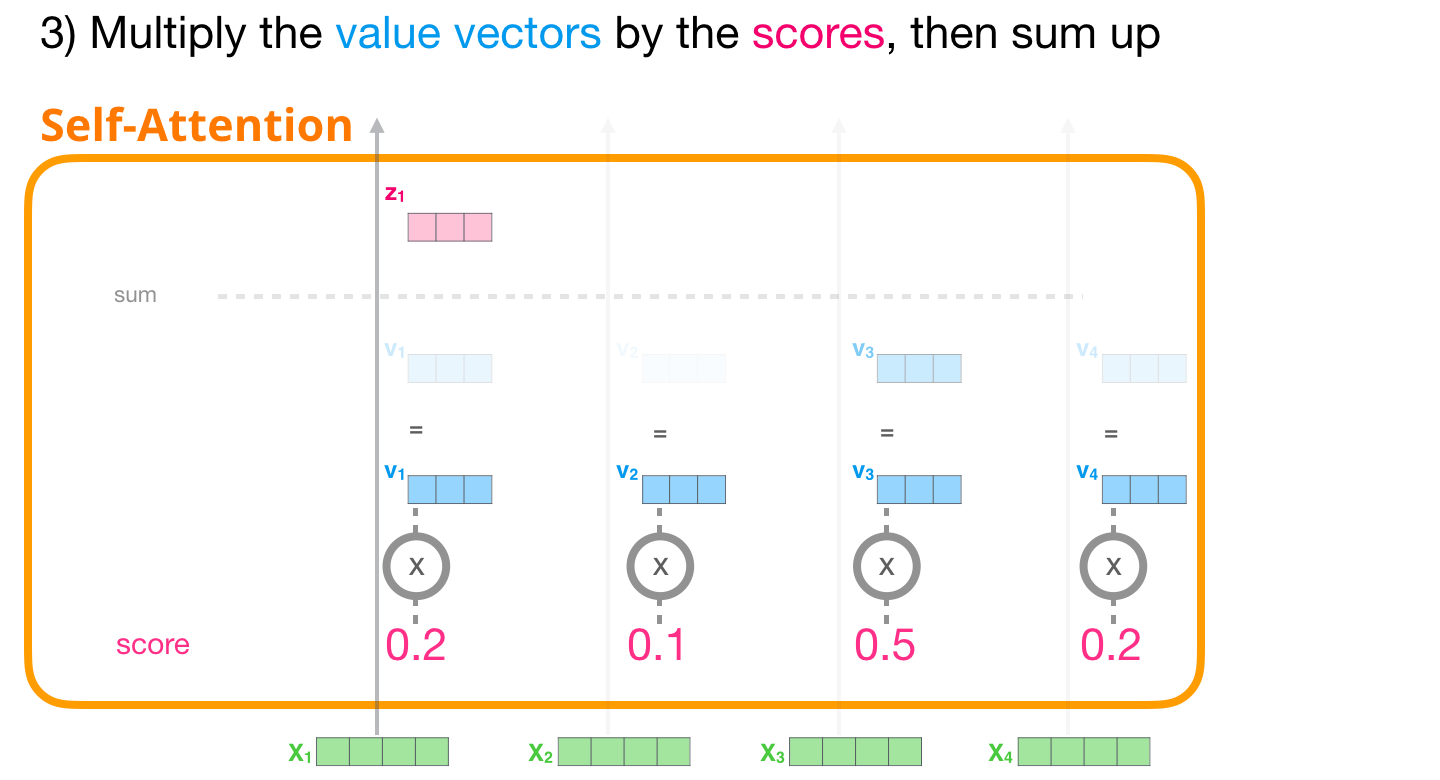

3 –

. , .

, – , .

, , . ( ).

, , , . №2. , . . , :

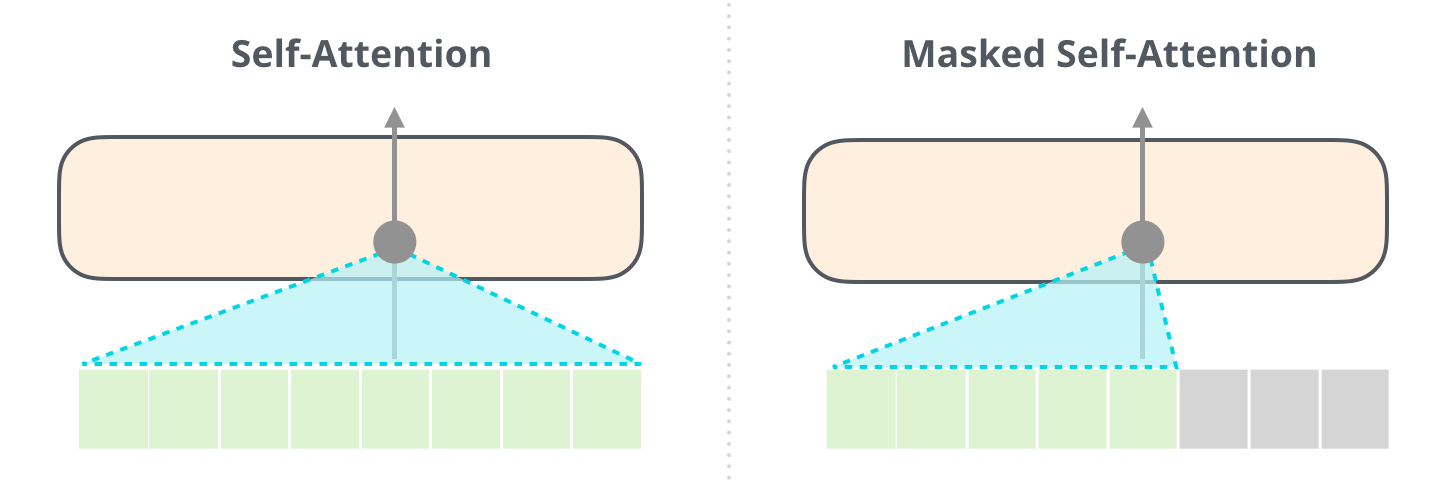

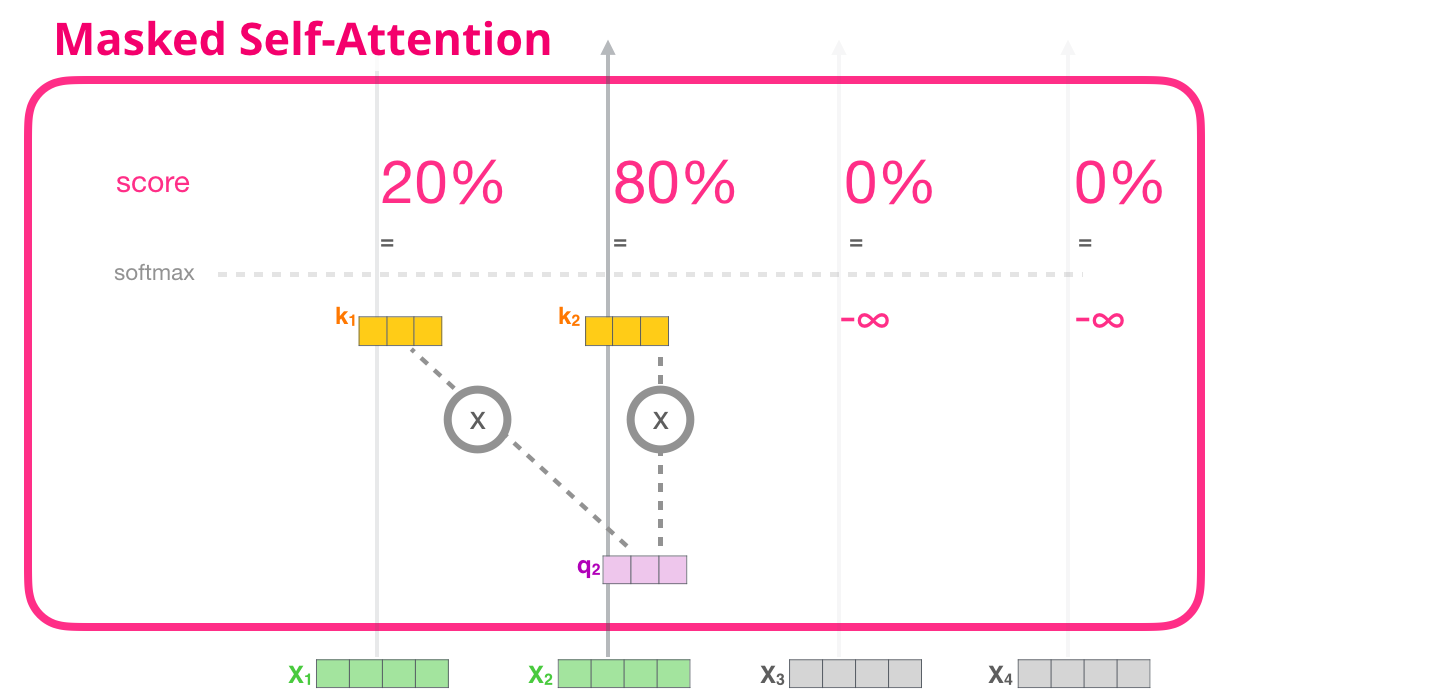

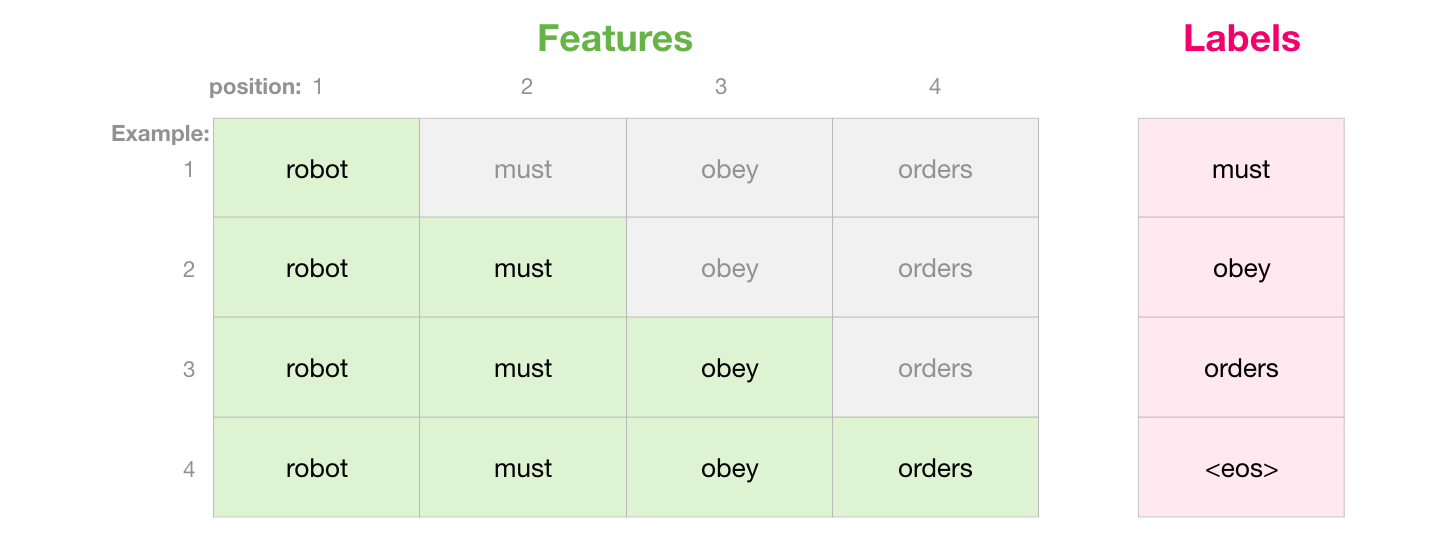

, (attention mask). , , («robot must obey orders»). 4 : ( , – ). .. , 4 , ( 4 ) .

, . , , ( ), :

«» . , , – (-inf) (, -1 GPT-2):

, , , :

:

- ( №1), («robot»), 100% .

- ( №2), («robot must»), «must» 48% «robot» 52% «must».

- ..

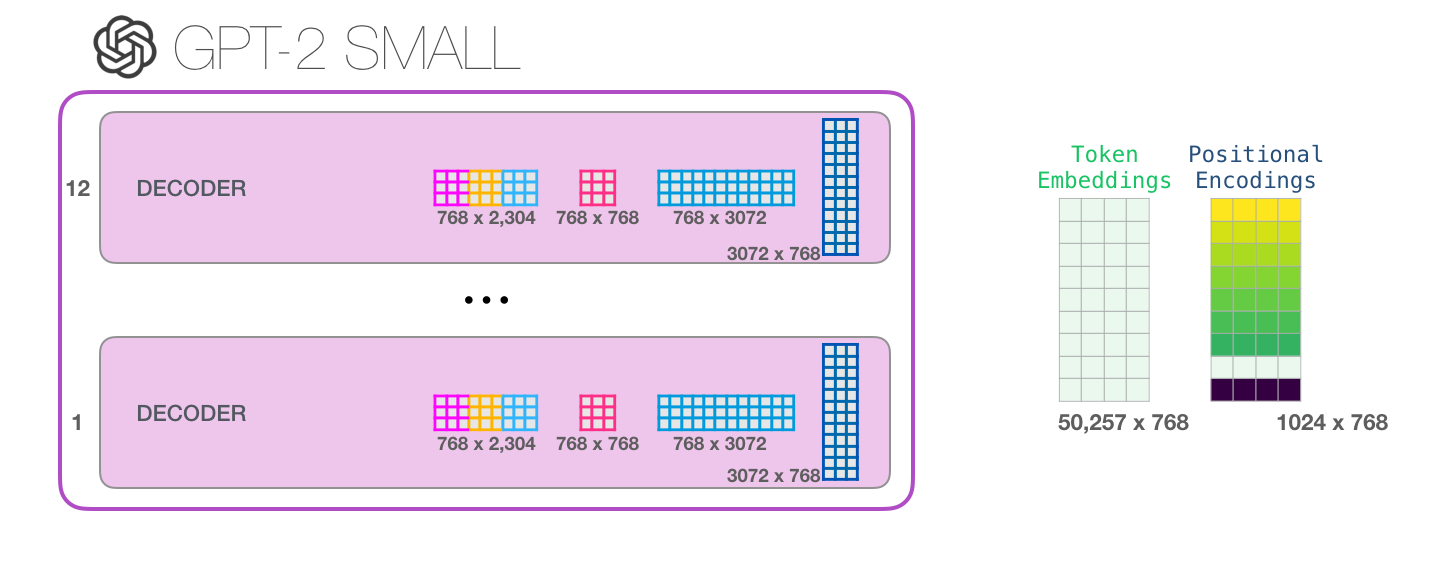

GPT-2

GPT-2.

:

, GPT-2 , . , , , .

( <|s|>).

GPT-2 «a». :

, «robot», , «a» – , :

GPT-2: 1 – ,

, «it». , «it» + #9:

( ), , .

(bias vector),

, , «it».

( ) ,

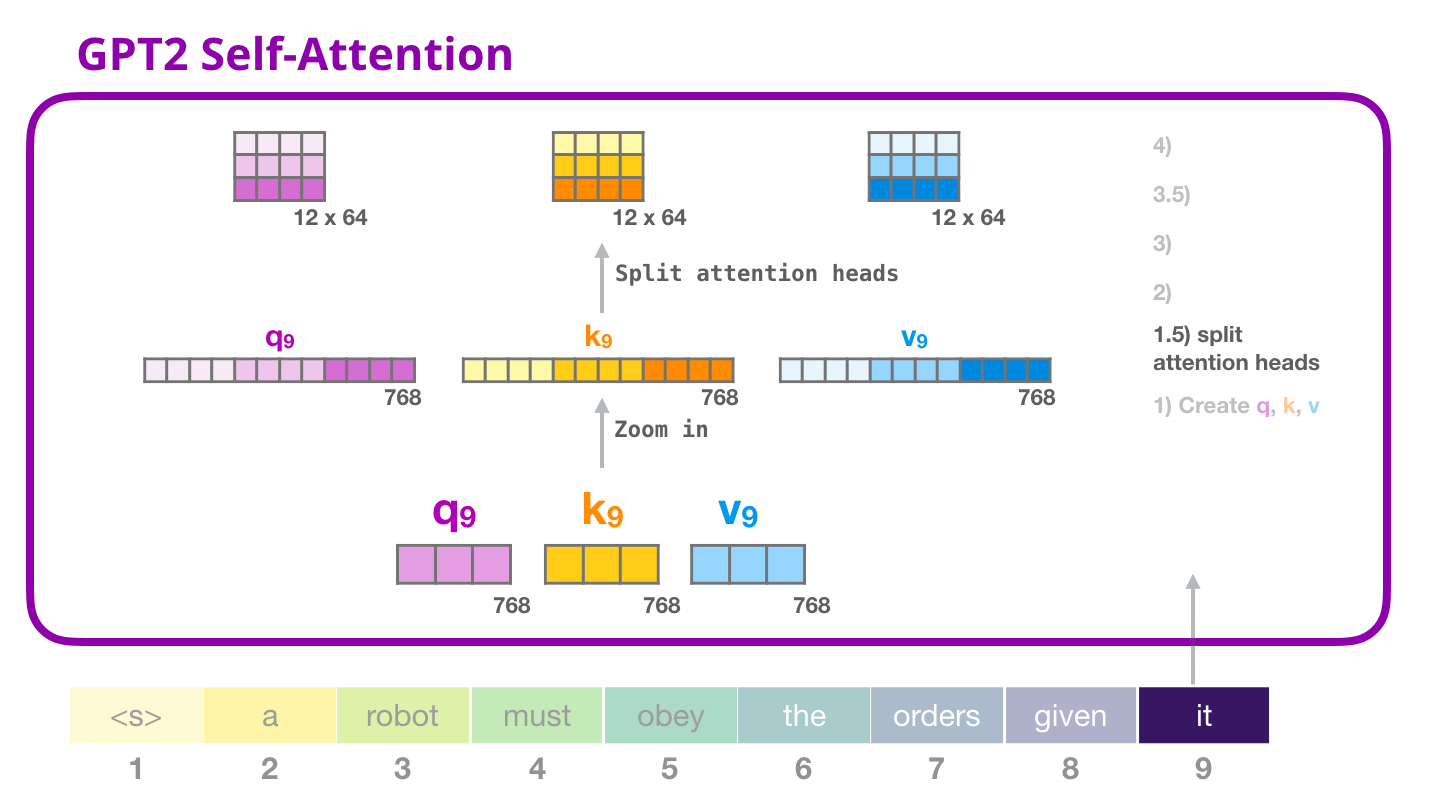

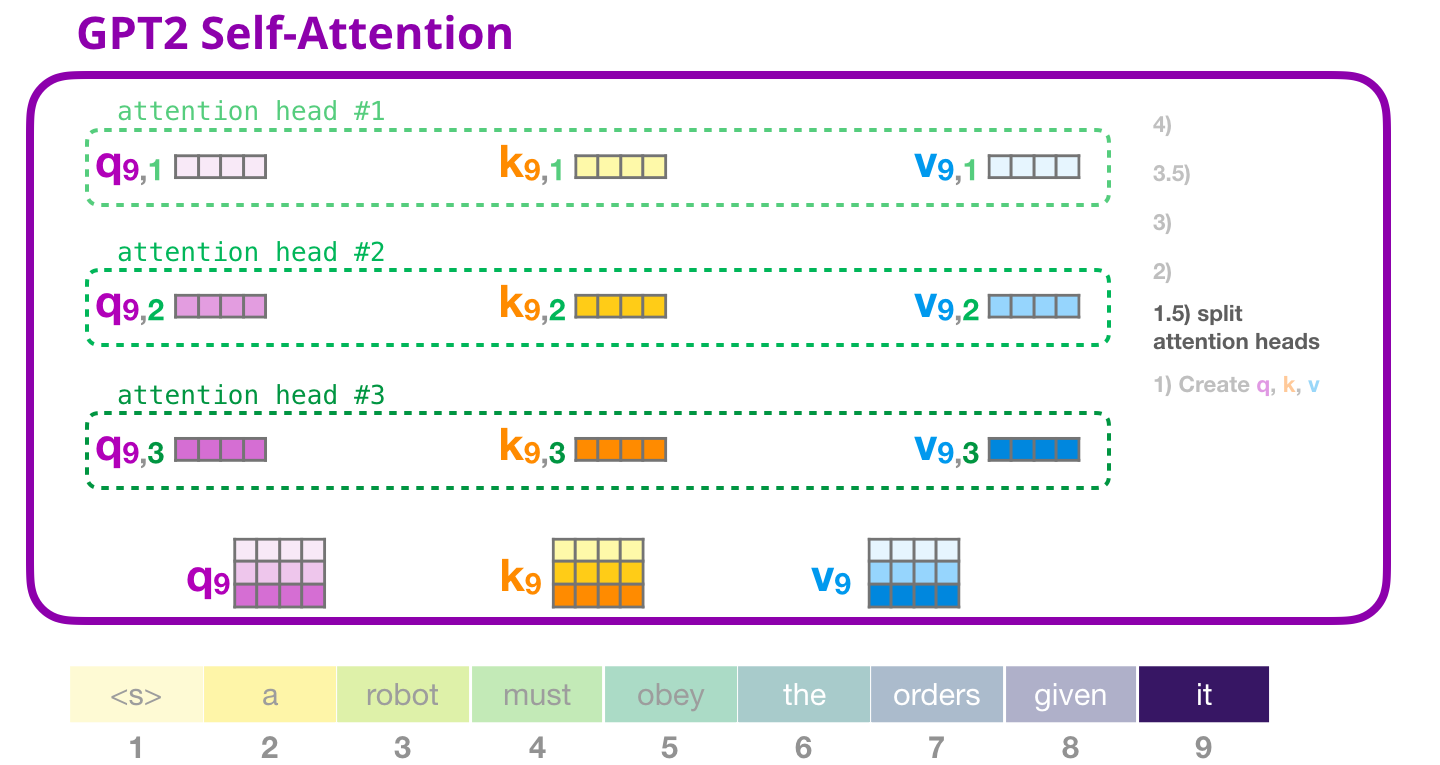

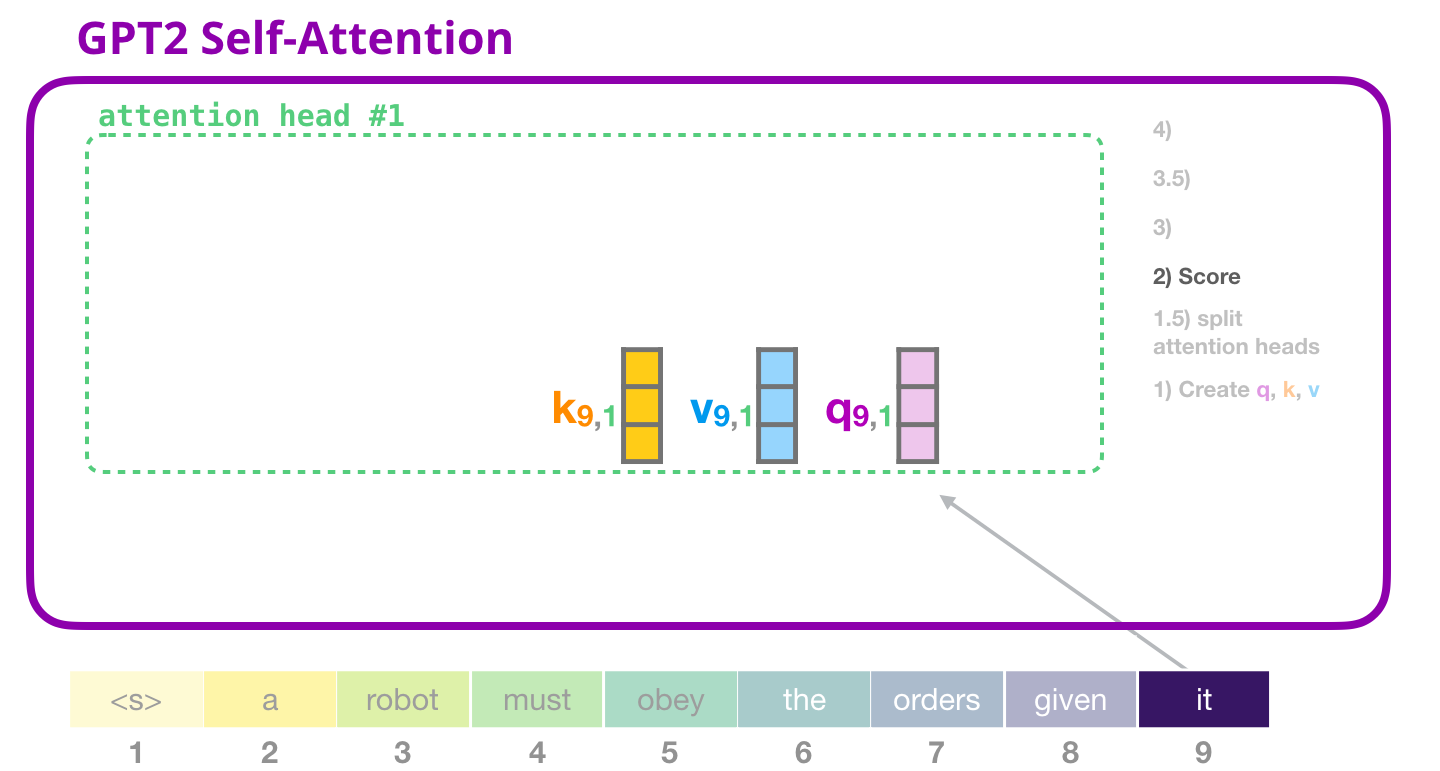

GPT-2: 1.5 – «»

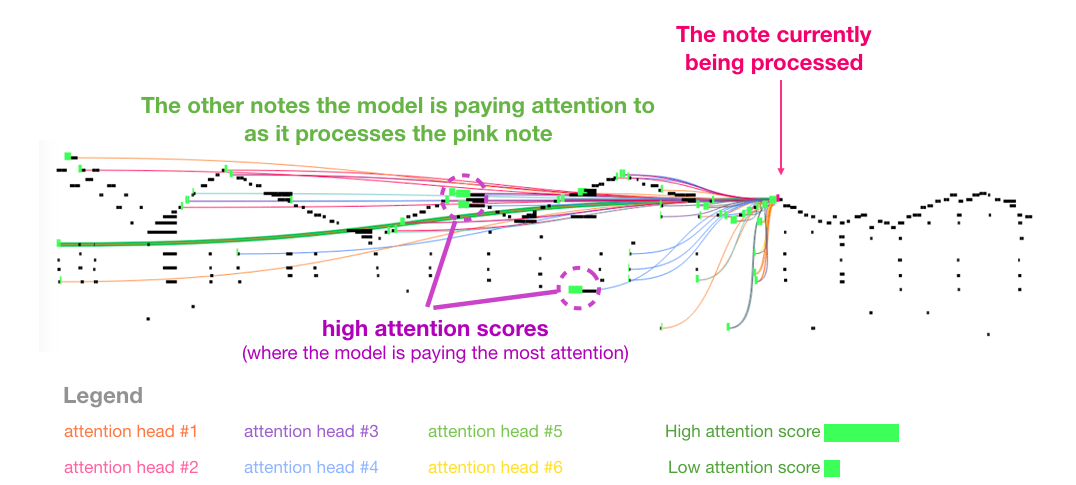

, «» . . (Q), (K) (V). «» – . GPT-2 12 «» , :

, «» . «» , ( 12 «» ):

GPT-2: 2 –

( , «» ):

( «» #1 ):

GPT-2: 3 –

, , , «» #1:

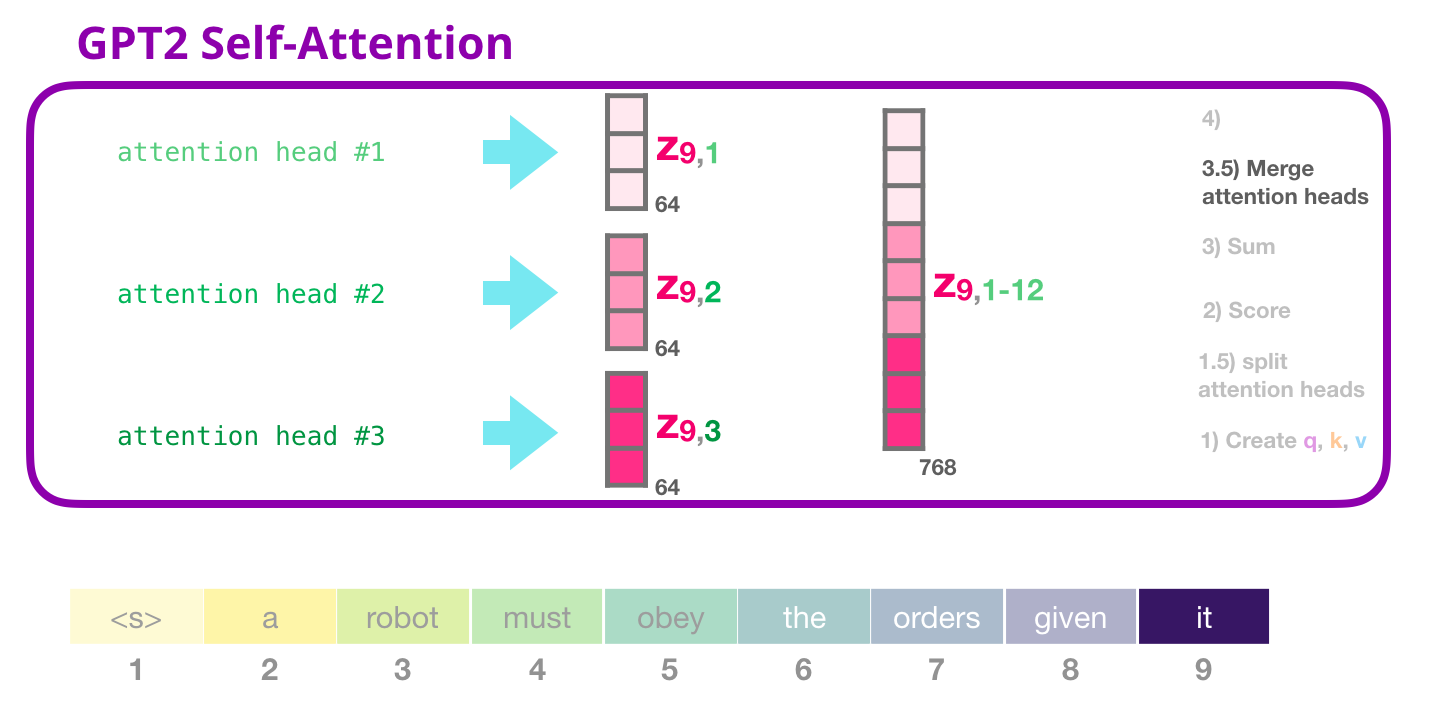

GPT-2: 3.5 – «»

«» , , :

. .

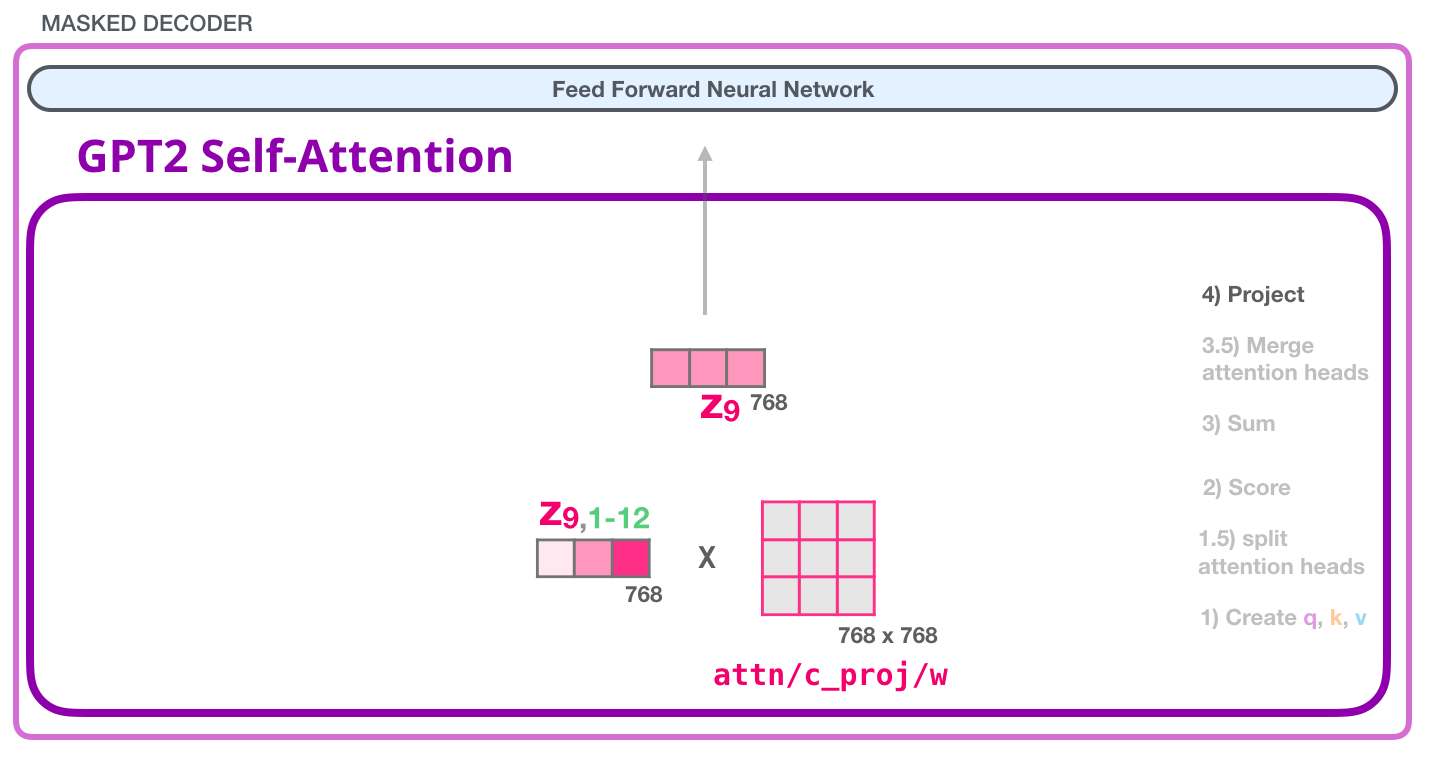

GPT-2: 4 –

, , . , «» :

, , :

GPT-2: #1

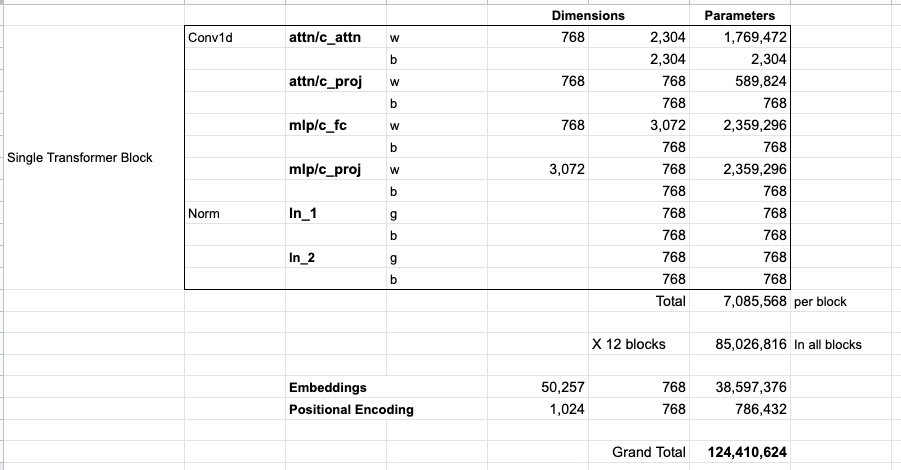

– , , . . 4 ( GPT-2 768, 768*4 = 3072 ). ? ( 512 #1 – 2048). , , .

( )

GPT-2:

(768 GPT-2). .

( )

!

, - . , . , , :

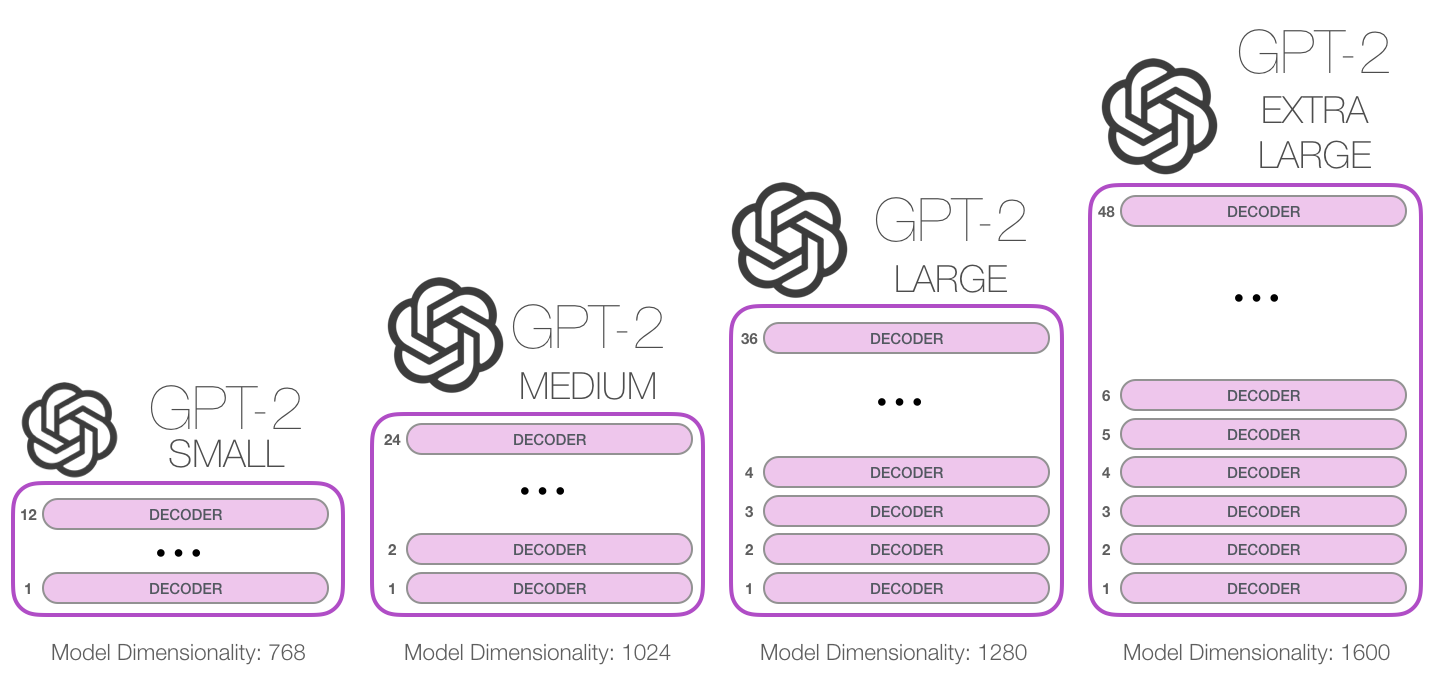

. , :

, :

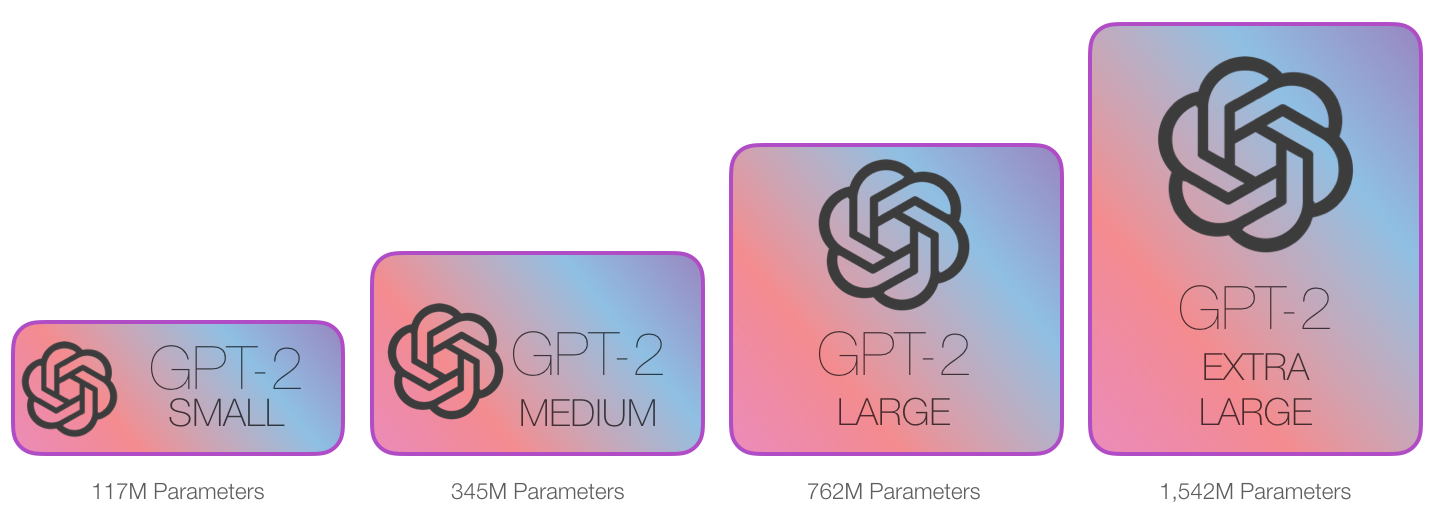

- 124 117. , , (, ).

3:

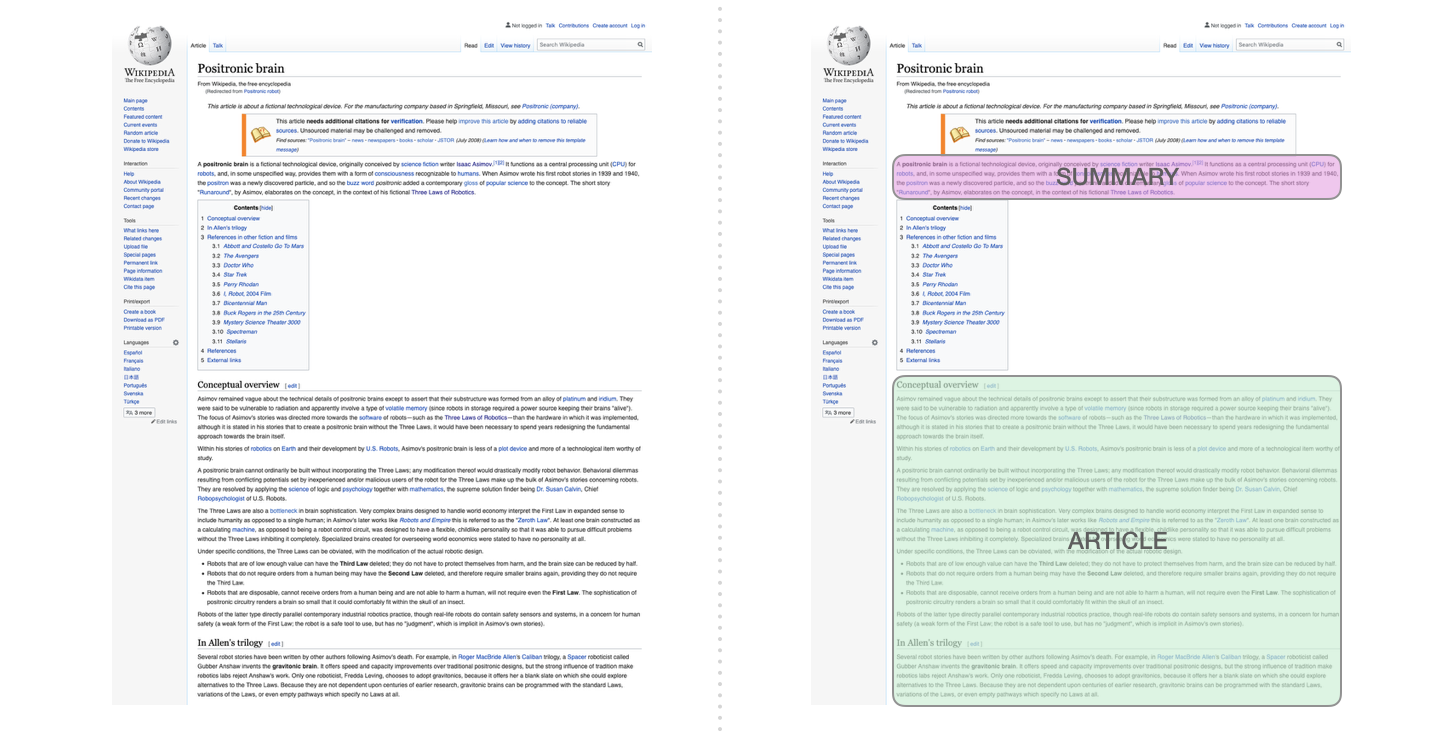

, . , . .

. :

, . , ( , ) . :

.

Sample Efficient Text Summarization Using a Single Pre-Trained Transformer , . , , - .

GPT-2 .

. « » – (, « »).

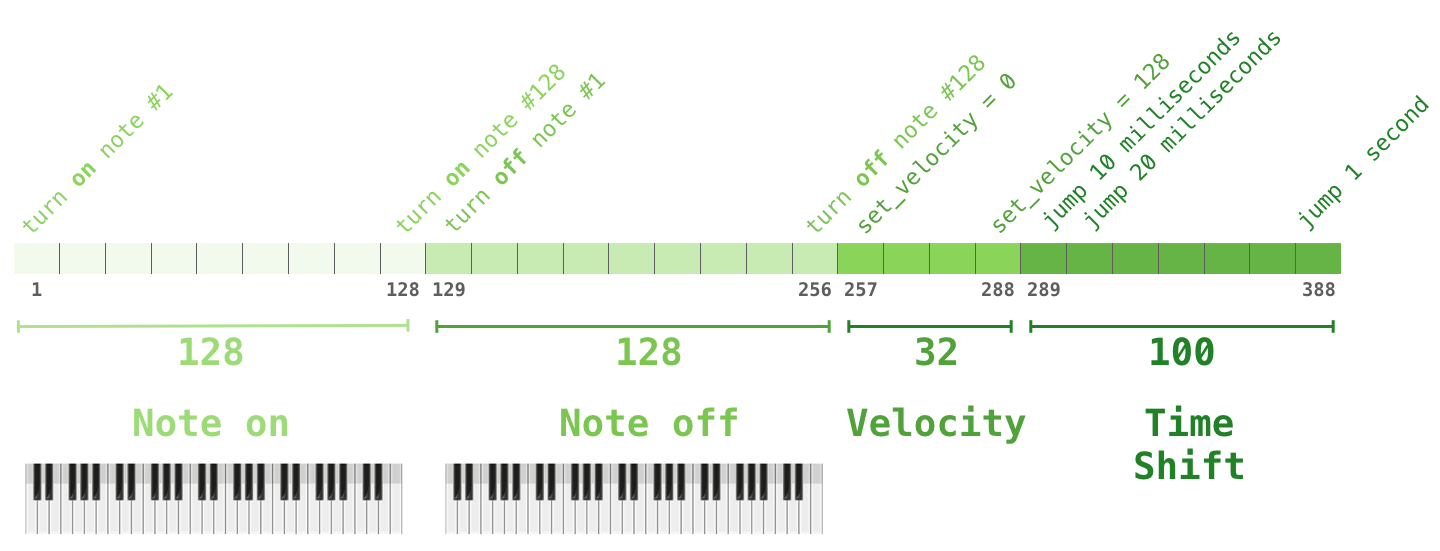

, . , (), ( ). (, , ) «» – , .

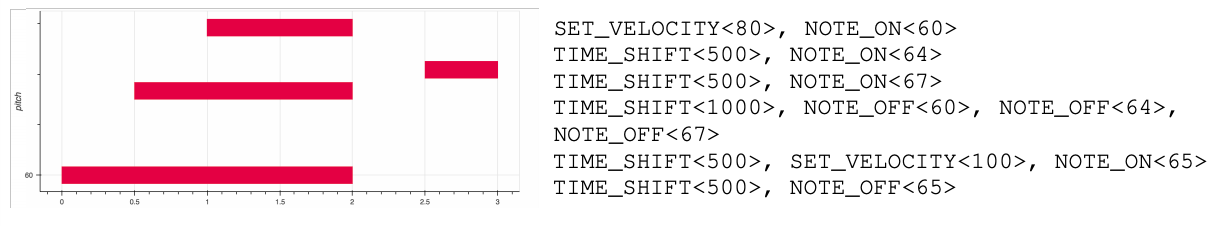

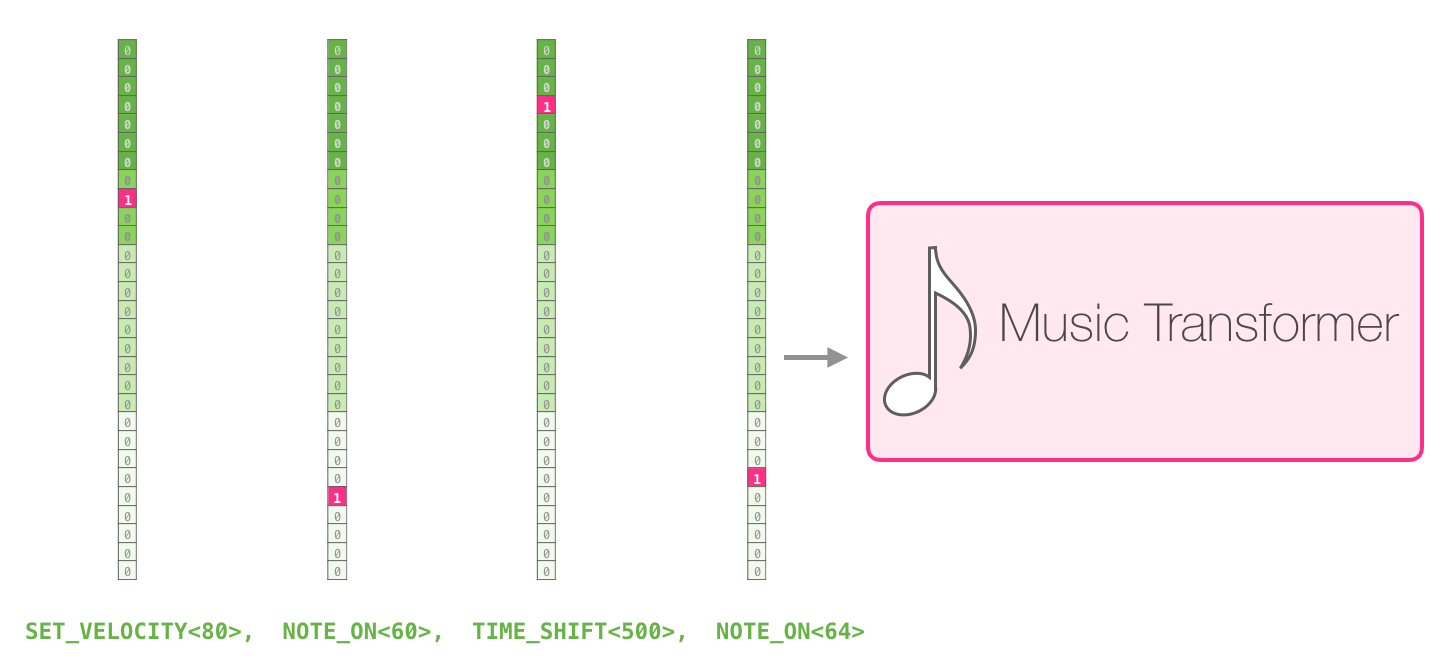

– one-hot . midi . :

one-hot :

:

, . .

GPT-2 – . , , , , .

- GPT-2 OpenAI

- हगिंग फेस से pytorch-transformers2 लाइब्रेरी देखें , जो GPT-2 के अलावा BERT, ट्रांसफॉर्मर-एक्स्ट्रा लार्ज, XLNet और अन्य एडवांस्ड ट्रांसफॉर्मर मॉडल को लागू करता है।

लेखक