Les processus des neurones humains ont montré une capacité inattendue à calculer

Les dendrites, processus de certains neurones dans le cerveau humain, peuvent effectuer des calculs logiques qui, comme on le pensait précédemment, ne peuvent que des réseaux de neurones entiers

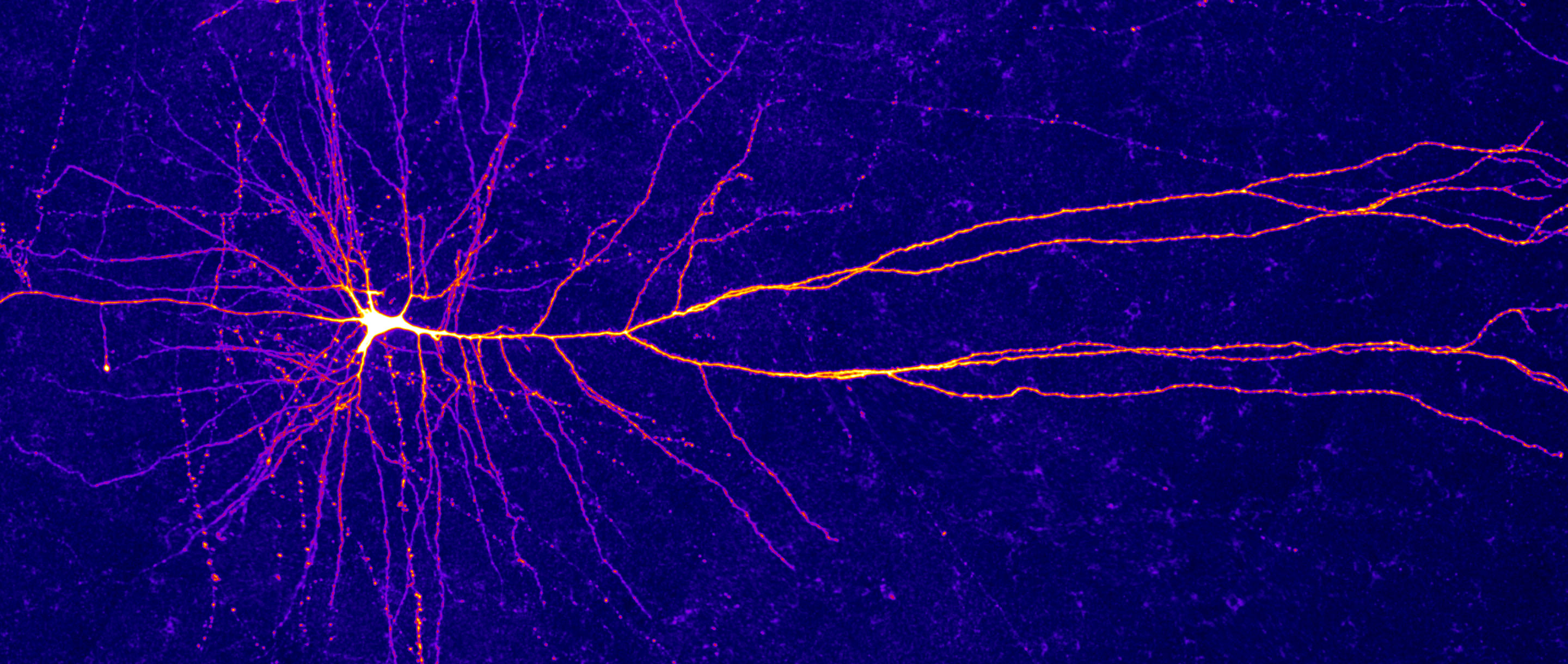

De minces dendrites ressemblant aux racines d'une plante divergent dans toutes les directions du corps cellulaire de ce neurone cortical. Les dendrites individuelles peuvent traiter indépendamment les signaux reçus des neurones voisins avant de les transférer à l'entrée de la cellule.On nous dit souvent que la capacité du cerveau à traiter les informations réside dans les billions de connexions qui connectent ses neurones au réseau. Mais au cours des dernières décennies, de plus en plus de recherches ont progressivement détourné l'attention sur les neurones individuels, qui assument une responsabilité beaucoup plus grande en informatique que ce que l'on imaginait auparavant.Le plus récent de ces nombreux témoignages est associé à la découverte par les scientifiques d'un nouveau type de signal électrique traversant les niveaux supérieurs du cortex cérébral humain. Dans des études en laboratoire et sur des modèles, il a déjà été démontré que de minuscules compartiments de dendrites, processus des neurones du cortex cérébral, sont eux-mêmes capables d'effectuer des opérations complexes dans le domaine de la logique mathématique. Cependant, il apparaît maintenant que les compartiments dendritiques individuels peuvent également effectuer une opération spéciale - un « OU exclusif » (XOR) - qui, comme on le pensait précédemment, n'était pas disponible pour les neurones individuels."Je pense que nous sommes assez peu creusés dans le domaine de ce qui est réellement impliqué dans les neurones", - a déclaré Albert Gideon , post-doctorant à l'Université de Humboldt à Berlin, auteur principal de la revue Science a publié des travaux , qui décrit cette découverte.Cette découverte démontre le besoin toujours croissant de neurones individuels d'être considérés comme des processeurs d'informations complexes dans les études du système nerveux. "Le cerveau peut être beaucoup plus complexe que nous ne le pensions", a déclaré Conrad Cording ., neuroscientifique en informatique de l'Université de Pennsylvanie qui n'était pas impliqué dans ce travail. La découverte pourrait peut-être également inciter les informaticiens à modifier les stratégies de travail des réseaux de neurones artificiels, dans lesquels les neurones ont toujours été considérés comme de simples commutateurs.

De minces dendrites ressemblant aux racines d'une plante divergent dans toutes les directions du corps cellulaire de ce neurone cortical. Les dendrites individuelles peuvent traiter indépendamment les signaux reçus des neurones voisins avant de les transférer à l'entrée de la cellule.On nous dit souvent que la capacité du cerveau à traiter les informations réside dans les billions de connexions qui connectent ses neurones au réseau. Mais au cours des dernières décennies, de plus en plus de recherches ont progressivement détourné l'attention sur les neurones individuels, qui assument une responsabilité beaucoup plus grande en informatique que ce que l'on imaginait auparavant.Le plus récent de ces nombreux témoignages est associé à la découverte par les scientifiques d'un nouveau type de signal électrique traversant les niveaux supérieurs du cortex cérébral humain. Dans des études en laboratoire et sur des modèles, il a déjà été démontré que de minuscules compartiments de dendrites, processus des neurones du cortex cérébral, sont eux-mêmes capables d'effectuer des opérations complexes dans le domaine de la logique mathématique. Cependant, il apparaît maintenant que les compartiments dendritiques individuels peuvent également effectuer une opération spéciale - un « OU exclusif » (XOR) - qui, comme on le pensait précédemment, n'était pas disponible pour les neurones individuels."Je pense que nous sommes assez peu creusés dans le domaine de ce qui est réellement impliqué dans les neurones", - a déclaré Albert Gideon , post-doctorant à l'Université de Humboldt à Berlin, auteur principal de la revue Science a publié des travaux , qui décrit cette découverte.Cette découverte démontre le besoin toujours croissant de neurones individuels d'être considérés comme des processeurs d'informations complexes dans les études du système nerveux. "Le cerveau peut être beaucoup plus complexe que nous ne le pensions", a déclaré Conrad Cording ., neuroscientifique en informatique de l'Université de Pennsylvanie qui n'était pas impliqué dans ce travail. La découverte pourrait peut-être également inciter les informaticiens à modifier les stratégies de travail des réseaux de neurones artificiels, dans lesquels les neurones ont toujours été considérés comme de simples commutateurs.Limites du modèle de neurone stupide

Dans les années 40 et 50, une certaine idée a commencé à dominer en neurobiologie: le rôle "muet" d'un neurone comme simple intégrateur, un point de réseau résumant toutes les entrées. Les processus de ramification de la cellule, les dendrites, reçoivent des milliers de signaux des neurones voisins - dont certains sont excitants, d'autres - inhibiteurs. Dans le corps d'un neurone, tous ces signaux sont pesés et additionnés, et si la somme dépasse un certain seuil, le neurone produit une séquence d'impulsions électriques (en fait, des potentiels électriques) qui contrôlent la stimulation des neurones voisins.À peu près au même moment, les chercheurs ont réalisé qu'un seul neurone pouvait fonctionner comme une porte logique, comme ceux qui composent les circuits numériques (bien qu'il ne soit pas encore clair comment le cerveau effectue ces calculs lors du traitement de l'information). Le neurone était en fait la «porte ET», car il n'était activé qu'après avoir reçu la quantité nécessaire de données d'entrée.Ainsi, un réseau de neurones pourrait théoriquement effectuer tous les calculs. Pourtant, un tel modèle de neurone était limité. Ses métaphores de calcul étaient trop simplistes et, pendant des décennies, les unités expérimentales n'ont pas pu enregistrer l'activité de divers composants d'un neurone. "Il a essentiellement comprimé un neurone à un point dans l'espace", a déclaré Barlett Mel ., Neuroscientifique computationnel à l'Université de Californie du Sud. "Il n'avait aucune manifestation interne d'activité." Le modèle a ignoré le fait que des milliers de signaux entrant dans le neurone se trouvaient à différents points de ses différentes dendrites. Elle a ignoré l'idée (confirmée par la suite) que les dendrites individuelles peuvent fonctionner de différentes manières. Et elle a ignoré la possibilité que diverses structures internes du neurone puissent effectuer divers calculs.Cependant, dans les années 80, les choses ont commencé à changer. Des modèles du neuroscientifique Christoph Koch et d'autres, qui ont ensuite confirmé dans des expériences, ont démontréqu'un neurone ne produit pas un signal de tension unique ou uniforme. Au lieu de cela, les signaux ont diminué, passant le long de la dendrite dans le neurone et n'ont souvent pas contribué à la sortie cellulaire finale.Une telle isolation des signaux signifie que les dendrites individuels peuvent traiter les informations indépendamment les uns des autres. "Cela était contraire à l'hypothèse du neurone ponctuel, dans lequel le neurone empilait tout simplement quel que soit l'emplacement", a déclaré Mel.Cela a incité Koch et d'autres biologistes, dont Gordon Shepherdde Yale School of Medicine, pour modéliser comment la structure des dendrites pourrait en principe permettre à un neurone de fonctionner non pas comme une simple porte logique, mais comme un système complexe de traitement du signal à plusieurs composants. Ils ont simulé des arbres dendritiques, sur lesquels se trouvent de nombreuses opérations logiques qui fonctionnent à travers des mécanismes hypothétiques.Plus tard, Mel et ses collègues ont étudié plus en détail comment une cellule pouvait être contrôlée avec plusieurs signaux entrants sur des dendrites distinctes. Ce qu'ils ont trouvé les a surpris: les dendrites ont généré des pics locaux, ils avaient leurs propres courbes d'entrée / sortie non linéaires et leurs propres seuils d'activation qui différaient du neurone dans son ensemble. Les dendrites eux-mêmes pourraient fonctionner comme des portes «I», ou placer d'autres appareils informatiques sur eux-mêmes.Craie avec un ancien étudiant diplôméYota Poiratsi (qui travaille actuellement en tant que neuroscientifique informatique à l'Institut de biologie moléculaire et de biotechnologie en Grèce), a réalisé que cela signifie qu'un seul neurone peut être considéré comme un réseau à deux couches . Les dendrites servent de modules informatiques non linéaires auxiliaires qui collectent des données d'entrée et fournissent des données de sortie intermédiaires. Ensuite, ces signaux sont combinés dans le corps de la cellule, ce qui détermine comment le neurone dans son ensemble y répondra. Yota Poiratsi, neuroscientifique en informatique à l'Institut de biologie moléculaire et de biotechnologie en GrèceIl n'était pas clair si l'activité au niveau des dendrites influençait l'activation d'un neurone et l'activité des neurones voisins. Mais dans tous les cas, un tel traitement local peut préparer ou configurer le système afin qu'il réponde différemment aux futurs signaux entrants, comme le dit Shepherd.Quoi qu'il en soit, "la tendance était la suivante: d'accord, faites attention, le neurone peut être plus capable, nous pensions", a déclaré Mel.Shepherd est d'accord. "Une quantité importante de calculs ayant lieu dans le cortex est à un niveau qui n'atteint pas le seuil", a-t-il déclaré. «Un système à partir d'un seul neurone peut être plus que le seul intégrateur.» Il peut y avoir deux couches, voire plus. » En théorie, presque toutes les opérations de calcul peuvent être effectuées par un seul neurone avec un nombre suffisant de dendrites, chacune étant capable d'effectuer sa propre opération non linéaire.Dans un travail récent dans la revue Science, les chercheurs ont poussé cette idée encore plus loin. Ils ont suggéré qu'un seul compartiment de dendrite pourrait effectuer ces opérations complexes par lui-même.

Yota Poiratsi, neuroscientifique en informatique à l'Institut de biologie moléculaire et de biotechnologie en GrèceIl n'était pas clair si l'activité au niveau des dendrites influençait l'activation d'un neurone et l'activité des neurones voisins. Mais dans tous les cas, un tel traitement local peut préparer ou configurer le système afin qu'il réponde différemment aux futurs signaux entrants, comme le dit Shepherd.Quoi qu'il en soit, "la tendance était la suivante: d'accord, faites attention, le neurone peut être plus capable, nous pensions", a déclaré Mel.Shepherd est d'accord. "Une quantité importante de calculs ayant lieu dans le cortex est à un niveau qui n'atteint pas le seuil", a-t-il déclaré. «Un système à partir d'un seul neurone peut être plus que le seul intégrateur.» Il peut y avoir deux couches, voire plus. » En théorie, presque toutes les opérations de calcul peuvent être effectuées par un seul neurone avec un nombre suffisant de dendrites, chacune étant capable d'effectuer sa propre opération non linéaire.Dans un travail récent dans la revue Science, les chercheurs ont poussé cette idée encore plus loin. Ils ont suggéré qu'un seul compartiment de dendrite pourrait effectuer ces opérations complexes par lui-même.Des éclats inattendus et de vieux obstacles

Matthew Larkum , un neuroscientifique de Humboldt, et son équipe, ont commencé à étudier les dendrites sous différents angles. L'activité des dendrites a été principalement étudiée en utilisant des rongeurs à titre d'exemple, et les chercheurs se sont intéressés à la façon dont la propagation du signal peut différer dans les neurones humains, dont les dendrites sont beaucoup plus longues. Ils ont mis à la disposition des sections du tissu cérébral des 2e et 3e couches du cortex, qui contient des neurones particulièrement gros avec un grand nombre de dendrites. Et quand ils ont commencé à stimuler ces dendrites à l'aide du courant électrique, ils ont remarqué quelque chose d'étrange.Ils ont vu des sursauts inattendus et répétitifs - qui étaient complètement différents des autres signaux neuronaux connus. Ils étaient particulièrement rapides et courts, comme les potentiels d'action., et est due à des ions calcium. C'était intéressant car les potentiels d'action habituels sont générés par les ions sodium et potassium. Bien que les signaux générés par le calcium aient déjà été observés dans les dendrites de rongeurs, ces salves ont duré beaucoup plus longtemps.Encore plus étrange, une augmentation de l'intensité de la stimulation électrique a réduit le taux de réponse des neurones. "Soudain, nous, en stimulant plus, avons commencé à recevoir moins", a déclaré Gidon. "Il a attiré notre attention."Pour comprendre ce que ces nouveaux types de rafales peuvent faire, les scientifiques se sont associés à Poiratsi et à son chercheur de laboratoire grec Atanasia Paputzi pour créer un modèle qui reflète le comportement des neurones.Le modèle a montré que les dendrites produisent des salves en réponse à deux signaux d'entrée séparément, mais ne produisent pas si ces signaux sont combinés. C'est l'équivalent d'un calcul non linéaire, connu sous le nom de OU exclusif, ou XOR, donnant 1 seulement si un, et une seule des entrées est 1.Cette découverte a immédiatement trouvé un écho chez les informaticiens. Pendant de nombreuses années, on pensait qu'un neurone n'était pas capable de compter la fonction XOR. Dans le livre de 1969, Perceptrons, les informaticiens Marvin Minsky et Seymour Papert ont fourni des preuves que les réseaux de neurones artificiels monocouches ne pouvaient pas calculer le XOR. Cette conclusion a été un tel coup que de nombreux informaticiens ont expliqué par ce fait la stagnation dans laquelle se trouvaient les réseaux de neurones jusqu'aux années 1980.Les chercheurs des réseaux de neurones ont finalement trouvé des moyens de surmonter l'obstacle trouvé par Minsky et Papert, et les neuroscientifiques ont trouvé des exemples de ces solutions dans la nature. Par exemple, Poiratsi savait déjà qu'un seul neurone peut calculer XOR: seules deux dendrites en sont capables. Mais dans de nouvelles expériences, lui et ses collègues ont proposé un mécanisme biophysique plausible pour effectuer un tel calcul dans une seule dendrite."Pour moi, c'est un autre degré de flexibilité du système", a déclaré Poiratsi. «Cela montre que le système a plusieurs façons de faire les calculs.» Cependant, elle souligne que si un seul neurone est déjà en mesure de résoudre ce problème, "pourquoi alors le système devrait-il passer à des tours en créant des modules plus complexes à l'intérieur du neurone?"Processeurs à l'intérieur des processeurs

Bien sûr, tous les neurones ne sont pas comme ça. Gidon dit que dans d'autres parties du cerveau, il y a quelques neurones plus petits et pointus. Probablement, une telle complexité des neurones existe pour une raison. Alors, pourquoi certaines parties des neurones ont-elles besoin de pouvoir faire ce dont un neurone est capable, ou un petit réseau de neurones? L'option évidente est un neurone qui se comporte comme un réseau multicouche, peut traiter plus d'informations et, en conséquence, il est préférable d'apprendre et de stocker davantage. "Peut-être que nous avons tout un réseau profond dans un neurone séparé", a déclaré Poiratsi. "Et c'est un appareil beaucoup plus puissant pour enseigner des tâches complexes."Cording ajoute peut-être: «Le seul neurone capable de calculer des fonctions vraiment complexes. Par exemple, il pourrait reconnaître indépendamment l'objet. " La présence de tels neurones individuels puissants peut aider le cerveau à économiser de l'énergie, selon Poiratsi.Le groupe Larkum prévoit de rechercher des signaux similaires dans les dendrites de rongeurs et d'autres animaux pour déterminer si ces capacités de calcul sont propres aux humains. Ils veulent également aller au-delà du modèle pour relier l'activité observée des neurones au comportement réel. Poiratsi espère comparer les calculs de dendrite avec ce qui se passe dans les réseaux de neurones afin de comprendre quels avantages peuvent survenir dans le premier cas. Cela comprendra la vérification d'autres opérations logiques et l'exploration de la façon dont elles peuvent contribuer à l'apprentissage ou à la mémorisation. «Jusqu'à ce que nous marquions tout cela, nous ne pouvons pas apprécier l'importance de la découverte», a déclaré Poiratsi.Bien qu'il y ait encore beaucoup de travail à faire, les chercheurs pensent que ces découvertes démontrent la nécessité de repenser l'approche de la modélisation du cerveau. Il ne suffit peut-être pas de se concentrer uniquement sur la connectivité de divers neurones et régions cérébrales.De nouveaux résultats devraient également soulever de nouvelles questions dans les domaines de l'apprentissage automatique et de l'intelligence artificielle. Les réseaux de neurones artificiels fonctionnent avec les neurones ponctuels, les considérant comme des nœuds qui additionnent l'entrée et transmettent la somme via la fonction d'activation. «Très peu de gens ont pris au sérieux l'idée qu'un seul neurone pourrait être un appareil informatique sophistiqué», a déclaré Gary Marcus , un scientifique cognitif à l'Université de New York, qui était très sceptique à propos de certaines des affirmations du deep learning.Bien que le travail du magazine Science ne soit qu'une découverte dans la riche histoire des travaux démontrant cette idée, les informaticiens peuvent y réagir plus activement car il fonctionne avec le problème XOR, qui a si longtemps tourmenté la recherche sur les réseaux de neurones. "Elle semble dire que nous devons y réfléchir sérieusement", a déclaré Marcus. "Tout ce jeu - obtenir un raisonnement intelligent à partir de neurones stupides - peut être faux.""Et cela démontre très clairement ce point de vue", a-t-il ajouté. "Cette performance va étouffer tout le bruit de fond."Source: https://habr.com/ru/post/undefined/

All Articles